亲缘关系识别在失踪人口或嫌疑人的搜寻、解决亲缘关系纠纷等方面发挥着不可替代的作用, 尤其在失踪人口找回领域. 由于目前的DAN技术鉴别耗时长、成本大, 无法实现对所有走失人群进行DAN配对检查, 需要一个识别效果好的亲缘关系识别模型对失踪人口进行初步处理, 提供亲缘相似度大的样本做进一步的DAN鉴定. 在计算机视觉识别领域中, 卷积神经网络在人脸识别、年龄识别和表情识别等识别任务上取得了巨大成功, 却在亲缘关系的识别上表现不佳. 这是因为大多数现有的亲缘关系识别模型使用所有卷积层可提取的特征进行相似度计算, 识别精度受到了与亲缘关系非相关特征的影响而降低; 虽然有部分亲缘关系识别模型[1-4]在识别过程中尽可能减轻了亲缘关系非相关特征的影响, 但由于这些模型大都忽略了子女与双亲之间的生物遗传关系, 它们在挑战性样本面前表现依旧不佳. 即使现有的实现子女与双亲关系识别的模型考虑了子女与双亲在生物遗传上的关联性, 但由于它们在识别过程中没有解决子女与双亲的年龄、性别等差距的问题, 从而对一些差异较大的样本识别效果不佳.

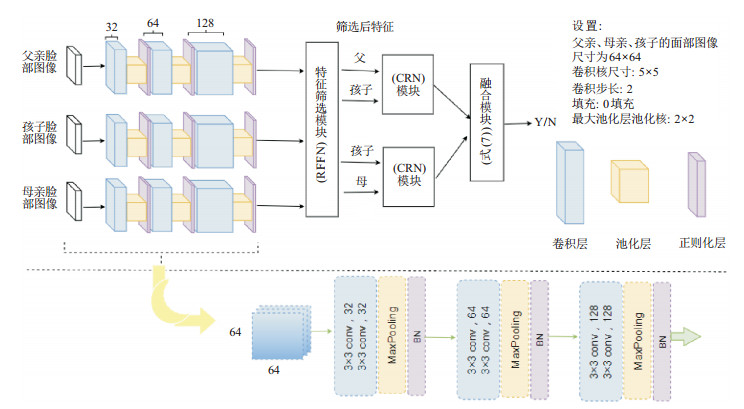

为了提高子女与双亲的亲缘关系识别精度, 本文提出一种可以有效解决在识别子女与双亲之间亲缘关系中存在年龄、性别等差距的基于判别式度量学习和典型相关分析的双亲亲缘关系识别网络, 即TSKRM (tri-subject kinship recognition model based on discriminant metric learning and canonical correlation analysis), 如图 1所示. 用于处理子女与双亲的面部特征的TSKRM是一个孪生架构的多线性网络[5-6], 从而利用子女与双亲的生物遗传关系提高亲缘关系识别精度. 它的设计方法是利用不同特征之间距离的差异, 通过判别式度量学习[7]提取出仅与亲缘关系相关的特征, 减轻年龄、性别等与亲缘关系非相关特征对识别过程的影响; 利用典型相关分析计算子女与双亲特征的相似度协方差矩阵并融合子女与双亲的相似度实现双亲亲缘关系的识别. 同时, 为了解决实际训练中完整家庭成员面部数据量小的限制, 进一步提高亲缘关系的识别精度, TSKRM采用“Coarse-to-Fine"训练思想分模块训练: 首先, 在公开的大型人脸数据库上训练卷积层以确保卷积部分具有鲁棒性的特征提取能力; 然后, 在单亲关系的人脸数据库训练模型对亲缘关系相关特征的提取能力和识别能力; 最后, 使用双亲关系的数据集微调TSKRM以实现对双亲关系识别能力的提高.

|

图 1 网络结构 |

本文在亲缘关系识别领域的主要贡献如下:

1) 孪生架构的多线性识别网络能更有效地利用子女与双亲生物遗传关系实现亲缘关系识别精度的提高.

2) 利用判别式度量学习和典型相关分析从卷积后的特征图中提取仅与亲缘关系相关的特征用于识别, 可大大减轻因子女与双亲的年龄、性别等差距对识别结果的影响, 提高了亲缘关系识别精度.

3) “Coarse-to-Fine”训练方法打破了双亲亲缘关系训练数据集小的限制, 可有效提高模型不同部分相应的特征处理能力, 达到“

自从dal Martello等[8]和DeBruine等[9]提出了在人类视觉信号处理领域中通过生物遗传子女与父母的面部外貌是具有相似性的, 而且子女的面貌看起来相比其他的成年人更像与他们性别相同的父亲或母亲, 通过子女与父母的面部图像来识别他们的亲缘关系已逐渐成为视觉领域中的研究热点. 现阶段已有的亲缘关系识别模型大多是识别单亲亲缘关系的, 例如文献[1, 8-16]等模型; 只有少数的, 如文献[17-19]中的模型是识别双亲亲缘关系的. 其中一个研究热点是如何在面部特征中选择出用于亲缘关系识别的各种类型的特征描述符. 例如, Guo等[12]提出使用空间高斯核分割子女与父母的眼睛、嘴巴等局部面部区域并提取DAISY特征描述符进行亲缘关系相似度匹配, 它的优势在于可以找到子女与父母面部外表相似程度高的面部区域, 但在子女与父母不相像的样本上表现不佳; Yan等[4]使用基于原型的鉴别特征学习(PDFL)方法提取面部特征中更有区分性的中级特征进行亲缘关系识别; 而Zhou等[20]虽然使用了低级的手工描述符, 但该模型使用识别速度更快的基于空间金字塔的方式提取面部特征进行亲缘关系识别, 并提出了一种基于Gabor[21]的梯度定向金字塔(GGOP)特征表示方法, 用于从面部图像进行亲缘关系验证, 即利用Gabor小波获取一组来自不同比例和方向的Gabor幅值(GM)特征图像, 随后融合从GM中提取的梯度定向金字塔(GOP)特征进行亲缘关系验证. 不同的特征提取方法使得模型的亲缘关系识别能力不同, 但他们都无法处理子女与父母的年龄、性别的差异.

针对子女与父母的年龄差异问题, 人们使用一种“嫁接桥”[2, 22-24]的方法, 即利用父母与孩子的年龄相似时的面部图像, 与孩子进行亲缘关系识别, 虽然在一定程度上提高了亲缘关系识别精度, 但这种方法对训练集有很高的要求. 近年来随着度量学习的流行, 在亲缘关系识别上引入度量学习也成为一大热点. 例如, 通过引入一种多视图邻域排除度量学习方法(MNRML)[1], 它通过度量正负样本的距离在面部特征空间中划分是否具有亲缘关系的超平面进行识别任务; 文献[3]引入度量学习来减少年龄因素对亲缘关系识别的影响, 主要通过度量由不同的特征描述符提取的多个特征之间的距离, 使得具有亲缘关系的样本特征经过度量后的距离远小于没有亲缘关系的距离, 从而实现亲缘关系识别; Hu等[13]提出了一种使用度量学习和多个特征描述符进行识别的方法, 即大规模多尺度学习(LM3L)方法, 它结合了多个全局距离度量, 最小化正样本面部特征的与预设阈值的距离, 最大化负样本面部特征与预设阈值的距离. 这些方法验证了引入度量学习的亲缘关系识别模型在减轻子女与父母的年龄差距上效果比其他方法效果更好.

虽然现有大多数亲缘关系识别方法的焦点都集中在单亲亲缘关系验证上, 然而有少数模型[17-19]考虑了实际亲缘关系识别中存在的双亲亲缘关系. Fang等[17]通过将亲缘关系识别转化为一般的家庭成员分类, 实现了双亲亲缘关系的识别, 具体做法为, 将给定需要查询的面部图像中的主要特征提取后, 使用最小的稀疏使其重建来得出子女属于哪个家庭、哪个分类; 文献[18]介绍了可以通过采用空间高斯核分割一系列小的面部补丁, 计算不同面部补丁的特征相似程度来判别输入的样本是否具有亲缘关系; Qin等[19] 使用“triplet loss”搭建了亲缘关系分类器, 通过识别并融合子女与双亲两种亲缘关系(子女与父亲, 子女与母亲)的概率实现双亲亲缘关系的识别. 尽管这些方法取得了成功, 但它们都忽略了子女与父母之间年龄差距及性别差距等这些与亲缘关系识别非相关因素的存在, 因此, 在识别父母与孩子相貌不相似的挑战性样本时效果不佳.

2 方法 2.1 特征选择模块RFFN假设

|

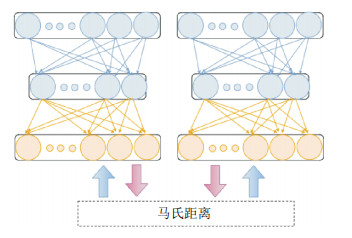

图 2 特征选择模块(RFFN) |

RFFN的目标是利用不同特征向量之间的Mahalanobis距离来选出与识别任务相关的特征. 假设给定两个数据

| $ \begin{align} d_A (x_i , y_i ) = \sqrt{((x_i-y_i )^{\rm T} \times A\times (x_i-y_i ) )}, \end{align} $ | (1) |

其中半正对称协方差矩阵

| $ \begin{align} &d_A (x_i, y_i ) = \sqrt{((x_i - y_i ) ^{\rm T} \omega ^{\rm T} \omega (x_i-y_i ))} = \\[3pt] & \sqrt{((\omega \times x_i- \omega \times y_i ) ^ {\rm T} (\omega \times x_i - \omega \times y_i ) )}. \end{align} $ | (2) |

因此, 求解

| $ \begin{align} &\mathop{\arg\max}_{\omega} {J} (\omega) = \\[2pt] &\sum\limits_{x_i, y_i}g(1-l_i (\tau-d_E (\omega \times x_i, \omega \times y_i ))) +\\[2pt] &\dfrac{\lambda}{2}\sum\limits_{m = 1} ^ M ((\omega ^ m)_F ^ 2 + (b ^ m)_2^2). \end{align} $ | (3) |

其中:

对于数据集

|

图 3 相似性分析模块(CRN) |

在求解特征向量

| $ \begin{align} \begin{cases} u_i = a_{i1} x_{i1}^\prime + a_{i2} x_{i2}^\prime+ \ldots + a_{im} x_{im}^\prime, \\ v_i = b_{i1} y_{i1}^\prime + b_{i2} y_{i2}^\prime + \ldots + b_{im} y_{im}^\prime. \end{cases} \end{align} $ | (4) |

识别对象

| $ \begin{align} &\rho(x_i^\prime, y_i^\prime ) = \rho(u_i, v_i ) = \\ &\dfrac{(u_i, v_i )}{\sqrt{(D(u_i )D(v_i ))}} = \dfrac{ \sum\limits_{i = 1}^nu_i\times v_i}{\sqrt{ \sum\limits_{i = 1}^nu_i^2}\sqrt{ \sum\limits_{i = 1}^nv_i^2}}. \end{align} $ | (5) |

CRN的优化目标函数为

| $ \begin{align} \mathop{\arg\max}_{a, b} {J} (a, b) = \sum (1+ {\rm log} (1+\rho(x_i^\prime, y_i^\prime) + \varepsilon)). \end{align} $ | (6) |

给定每组样本包含多个数据对象的数据集

| $ \begin{align} S_{\rm tri} = P_{(X_i, Y_i ) }\times C_{(x_i^\prime, y_i^\prime ) }+ P_{(Z_i, Y_i ) }\times C_{(z_i^\prime, y_i^\prime ) }. \end{align} $ | (7) |

其中

| $ \begin{align*} P_{(X_i, Y_i)} = \dfrac{{\rm exp}(C_{(x_i^\prime, y_i^\prime)})}{{\rm exp}(C_{(x_i^\prime, y_i^\prime)})+{\rm exp}(C_{(z_i ^\prime, y_i^\prime )} ) } \end{align*} $ |

代表识别对象

| $ \begin{align*} P_{(Z_i, Y_i ) } = \dfrac{{\rm exp}(C_{(z_i^\prime, y_i^\prime) } )}{{\rm exp}(C_{(x_i^\prime, y_i^\prime) } )+{\rm exp}(C_{(z_i^\prime, y_i^\prime) } )} \end{align*} $ |

代表识别对象

本节采用“由粗到细”的分阶段训练方法训练模型. 首先, 利用公认的人脸数据训练卷积网络的特征提取能力; 其次, 使用亲缘关系数据训练网络对亲缘相关性特征的筛选与相似性识别; 最后, 融合不同支线网络的识别结果并微调整体模型. 在实验中, 第1步训练使用源于香港中文大学公布的, 包含202 599张图像背景复杂、像素分辨率不同的, 性别、表情、姿势和年龄各不相同的人脸图像的Celeba数据库; 第2步训练使用包含4种亲缘关系(父子、父女、母子、母女)的KinfaceW-I和KinfaceW-II家庭成员人脸数据集, 其中KinfaceW-I分别有156、134、116和127对人脸图像, KinfaceW-II中每种关系各有250对人脸图像; 最后, 使用包含完整家庭关系(父亲- 母亲-孩子)共1 015对人脸图像的TSKinFace微调整体模型的权重.

使用迁移学习[6]训练网络, 将原始训练集标准化后, 利用交叉验证法将数据集划分为5等份, 其中3份用于模型训练, 1份用于模型验证, 1份用于模型测试.训练TSKRM的第1步是提取输入图像的特征, 用3个权重相同的卷积层提取图像特征, 并将提取的属于3个输入图像的特征映射到相同的特征空间; 第2步是筛选与亲缘关系识别相关的特征, 为了减少父母和孩子因年龄差异和性别差异对亲属关系识别准确性的影响, 引入RFFN模型来选择有用的特征; 第3步是特征相似性识别, CRN通过计算不同特征向量之间的相关系数来获得特征之间的相似性; 最后融合父亲与孩子、母亲与孩子的相似度作为亲缘关系识别结果.

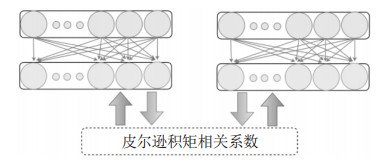

3.1 针对年龄与性别方面的实验比较为了更好地验证父母与子女的年龄差距和性别的不同会对最终的亲缘关系识别结果造成影响, 其中特征选择模块的功能就是过滤包含年龄和性别内容的特征, 尽可能多地提取与亲缘关系相关的特征.

为控制单一条件对实验的影响, 针对年龄差距对亲缘关系识别精度影响的实验: 将数据集样本对以父母与子女年龄差距为标准划分为年龄平均相差20

|

图 4 年龄差距对亲缘关系的影响效果 |

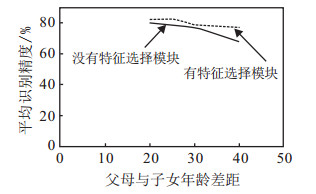

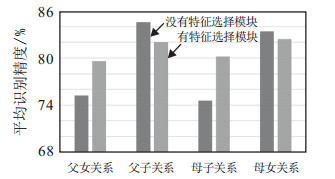

针对性别不同对亲缘关系识别精度影响的实验: 实验过程中固定年龄因素, 仅仅考虑性别因素. 为尽可能将年龄条件对识别的影响减低, 将实验样本中父母与子女年龄差距接近的样本对划分为同一组, 分别统计父亲与儿子、父亲与女儿、母亲与儿子、母亲与女儿的亲缘关系识别精度值. 如图 5所示, 性别关系对亲缘关系识别的影响表现为: 相同性别的亲子识别率高于不同性别的亲子; 在不同性别下, 使用特征选择模块的实验识别精度比没有使用特征选择模块的高, 这是由于特征选择模块极大程度地降低了性别对识别关系的影响, 在识别不同性别的亲子关系时, 提高了识别精度; 同理, 在相同性别下, 使用特征选择模块的实验精度比没有使用特征选择的低, 这是由于没有使用特征选择模块的方法在识别亲缘关系时, 错误地将性别特征判断为亲缘关系特征, 并将性别相似度错误地判断为亲缘关系相似度, 造成这种错误的原因是识别同性别亲缘关系时, 特征选择模块抑制了性别关系对识别结果的影响, 与没有特征选择模块的方法相比缺少部分相似的特征, 但这种识别相比于经过性别相似度“填充精度”更具说服力; 由于TSKRM模型为识别双亲亲缘关系的模型, 需同时处理同性别亲子和不同性别的亲子关系, 为消除性别因素对不同性别亲子的识别影响, 模型需要添加特征选择模块.

|

图 5 亲子性别不同对亲缘关系识别精度的影响效果 |

由于目前解决父亲、母亲和孩子3个对象之间亲缘关系识别问题的方法很少, 本文使用式(7)方法对两组识别单亲关系识别结果求和, 然后训练SVM进行预测, 以实现3个对象的亲缘关系识别作实验对比.

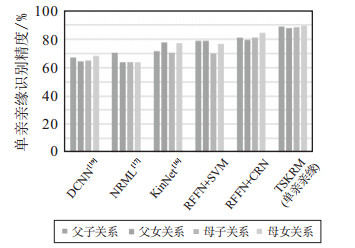

单亲关系: 使用两个在包含一对一亲缘关系的数据集(KinfaceW数据集)上最佳表现的方法, 使用深度卷积(DCNN)[31]和邻域排除度量学习(NRML)[1]作为比较模型. 在KinfaceW数据集上与本文方法进行识别一对一的亲缘关系比较. 实验结果如图 6所示, RFFN

|

图 6 在Kinface数据集上的对比 |

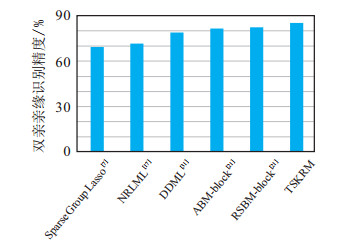

双亲亲缘关系实验结果如图 7所示, 在TSkinface数据上, 本文方法的识别准确度超过其他方法约3 %.

|

图 7 在TSKINFACE上的识别精度效果 |

本文提出的TSKRM设计过程如下:

1) 借鉴其他亲缘关系识别方法[3-4, 7, 13, 25, 27]. 引入一种判别性度量学习方法, 通过测量面部特征的距离, 选择出面部特征中包含与亲缘识别相关的基本特征并过滤不相关的特征, 比如年龄特征、性别特征等.

2) 本文借鉴了某些文献[29]的计算方法. 计算特征向量的相关系数的优点在于考虑了特征的各个部分之间的内部关系.

3) 采用阶段性训练方法[16]. 本文采用分段训练原则来学习TSKRM各部分的权重.该训练方法的优点在于可打破现有的家庭成员人脸数据的限制, 确保学习到的参数具有良好的鲁棒性.

4) 使用包含全部家庭成员的人脸数据来微调模型的权重参数, 以提高识别的准确性和鲁棒性.

TSKRM模型的成功实现, 有利于下一步关于亲缘关系生成模型的研究. 以此模型作为对抗生成网络的鉴别器, 可以有效地判断生成的新的面部图像是否与输入对象具有亲缘关系. 亲缘关系生成模型的研究更加促进了提升亲缘关系识别准确率的研究, 而对预测子女或父母的面部图像使得如失踪人口找回、子女认亲等社会实现方面更加准确、有效.

| [1] |

Lu J W, Zhou X Z, Tan Y P, et al. Neighborhood repulsed metric learning for kinship verification[C]. IEEE Transactions on Pattern Analysis and Machine Intelligence. Piscataway: IEEE, 2012: 331-345.

|

| [2] |

Xia S, Shao M, Fu Y, et al. Kinship verification through transfer learning[C]. International Joint Conference on Artificial Intelligence. Barcelona: ACM, 2011: 2539-2544.

|

| [3] |

Yan H B, Lu J W, Deng W H, et al. Discriminative multimetric learning for kinship verification[J]. IEEE Transactions on Information Forensics and Security, 2014, 9(7): 1169-1178. DOI:10.1109/TIFS.2014.2327757 |

| [4] |

Yan H B, Lu J W, Zhou X Z, et al. Prototype-based discriminative feature learning for kinship verification[J]. IEEE Transactions on Systems, Man, and Cybernetics, 2015, 45(11): 2535-2545. |

| [5] |

Vijay Kumar B G, Carneiro G, Reid I. Learning local image descriptors with deep Siamese and triplet convolutional networks by minimizing global loss functions[C]. 2016 IEEE Conference on Computer Vision and Pattern Recognition. CVPR, 2016: 5385-5394.

|

| [6] |

Melekhov I, Kannala J, Rahtu E. Siamese network features for image matching[C]. The 23rd International Conference on Pattern Recognition. Piscataway: IEEE, 2016: 378-383.

|

| [7] |

Hoffer E, Ailon N. Deep metric learning using triplet network[C]. Similarity-Based Pattern Recognition. Cham: Springer International Publishing, 2015: 84-92.

|

| [8] |

dal Martello M F, Maloney L T. Where are kin recognition signals in the human face?[J]. Journal of Vision, 2006, 6(12): 1356-1366. |

| [9] |

DeBruine L M, Smith F G, Jones B C, et al. Kin recognition signals in adult faces[J]. Vision Research, 2009, 49(1): 38-43. DOI:10.1016/j.visres.2008.09.025 |

| [10] |

Dibeklioglu H, Salah A A, Gevers T, et al. Like father, like son: Facial expression dynamics for kinship verification[C]. International Conference on Computer Vision. Sydney: IEEE, 2013: 1497-1504.

|

| [11] |

Fang R G, Tang K D, Snavely N, et al. Towards computational models of kinship verification[C]. International Conference on Image Processing. Hong Kong: IEEE, 2010: 1577-1580.

|

| [12] |

Guo G D, Wang X L. Kinship measurement on salient facial features[J]. IEEE Transactions on Instrumentation and Measurement, 2012, 61(8): 2322-2325. DOI:10.1109/TIM.2012.2187468 |

| [13] |

Hu J L, Lu J W, Yuan J S, et al. Large margin multi-metric learning for face and kinship verification in the wild[C]. Asian Conference on Computer Vision. Singapore: Springer Link, 2014: 252-267.

|

| [14] |

Kaminski G, Dridi S, Graff C, et al. Human ability to detect kinship in strangers${\rm{\ddot f}}$aces: Effects of the degree of relatedness[J]. Proceedings of Biological Sciences, 2009, 276(1670): 3193-3200. |

| [15] |

Kohli N, Singh R, Vatsa M, et al. Self-similarity representation of Weber faces for kinship classification[C]. International Conference on Biometrics Theory Aapplications and Systems. Arlington: IEEE, 2012: 245-250.

|

| [16] |

Li Y, Zeng J B, Zhang J, et al. KinNet: Fine-to-coarse deep metric learning for kinship verification[C]. Proceedings of the 2017 Workshop on Recognizing Families In the Wild. New York: ACM, 2017: 13-20.

|

| [17] |

Fang R G, Gallagher A C, Chen T, et al. Kinship classification by modeling facial feature heredity[C]. International Conference on Image Processing. Melbourne: IEEE, 2013: 2983-2987.

|

| [18] |

Ghahramani M, Yau W Y, Teoh E K. Family verification based on similarity of individual family member's facial segments[J]. Machine Vision & Applications, 2014, 25(4): 919-930. |

| [19] |

Qin X Q, Tan X Y, Chen S C, et al. Tri-subjects kinship verification: Understanding the core of a family[C]. International Conference on Machine Vision. Barcelona: IEEE, 2015: 580-583.

|

| [20] |

Zhou X Z, Hu J L, Lu J W, et al. Kinship verification from facial images under uncontrolled conditions[C]. ACM Multimedia. New York: ACM, 2011: 953-956.

|

| [21] |

Zhou X Z, Lu J W, Hu J L, et al. Gabor-based gradient orientation pyramid for kinship verification under uncontrolled environments[C]. ACM Multimedia. Hong Kong: ACM, 2012: 725-728.

|

| [22] |

Shao M, Kit D, Fu Y. Generalized transfer subspace learning through low-rank constraint[J]. International Journal of Computer Vision, 2014, 109(1/2): 74-93. |

| [23] |

Syed N, Mohd B K. Understanding familial relationship in an image[J]. International Journal of Scientific Research in Education, 2014, 2(6): 1037-1045. |

| [24] |

Xia S Y, Shao M, Luo J B, et al. Understanding kin relationships in a photo[J]. IEEE Transactions on Multimedia, 2012, 14(4): 1046-1056. DOI:10.1109/TMM.2012.2187436 |

| [25] |

Babagholami-Mohamadabadi B, Roostaiyan S M, Zarghami A, et al. Multi-modal distance metric learning: A Bayesian non-parametric approach[C]. European Conference on Computer Vision. Zürich: Springer, 2014: 63-77.

|

| [26] |

Qin Y P, Karimi H R, Li D, et al. A mahalanobis hyperellipsoidal learning machine class incremental learning algorithm[J]. Abstract and Applied Analysis, 2014(2014): 1-5. |

| [27] |

Xiang S M, Nie F P, Zhang C S, et al. Learning a Mahalanobis distance metric for data clustering and classification[J]. Pattern Recognition, 2008, 41(12): 3600-3612. DOI:10.1016/j.patcog.2008.05.018 |

| [28] |

Hu J L, Lu J W, Tan Y P, et al. Discriminative deep metric learning for face verification in the wild[C]. Computer Vision and Pattern Recognition. Columbus: IEEE, 2014: 1875-1882.

|

| [29] |

Andrew G, Arora R, Bilmes J A, et al. Deep canonical correlation analysis[C]. International Conference on Machine Learning. Georgia: JMLR. org, 2013: 1247-1255.

|

| [30] |

Lai P L, Fyfe C. Kernel and nonlinear canonical correlation analysis[J]. International Journal of Neural Systems, 2000, 10(5): 365-377. DOI:10.1142/S012906570000034X |

| [31] |

Zhang K H, Huang Y Z, Song C F, et al. Kinship verification with deep convolutional neural networks[C]. British Machine Vision Conference. Swansea: BMVA, 2015: 148.1-148.12

|

2021, Vol. 36

2021, Vol. 36