态势感知、威胁检测和跟踪对于广泛的军事和海事应用至关重要.由于无人机商业化程度逐渐提高, 它对军事和民用的威胁也日益增大.因此在军事和民用等领域, 反无人机将越来越重要, 各国在加紧研究无人机的同时, 亦大力发展反无人机产业, 实现“攻防一体”.反无人机技术得到了蓬勃发展, 大有百花争艳、百家争鸣的态势.因此, 对反无人机研究现状进行总结具有十分重要的意义, 这可以为目前的研究提供一些新的思路以及改进的方向.

反无人机是指通过一系列技术手段与设备对无人机进行反制, 使公共安全、公民隐私、国家安全等得到保障.目前反无人机技术存在以下难点.

1) 无人机逐渐隐身化、微小化, 且探测环境复杂. 在外型方面, 随着纳米复合材料、智能蒙皮结构等前沿技术的突破, 小型化、微小型化将成为无人机未来的发展趋势, 这将会导致信噪比低, 回波信号极易被杂波淹没.另一方面, 针对各探测手段无人机采用了复合材料、防红外反射技术等实现隐身化, 将大大增加探测难度.而在探测环境方面, 探测常常受到地形地物干扰, 导致信号衰减、信噪比低、目标被遮挡.

2) 无人机侦察-防御-攻击一体化, 作战效能成倍提高, 增加了防空系统的难度.近年来, 无人机逐渐发展为侦察-防御-攻击一体化, 能够实现多角色功能转换, 给目前的反无人机系统带来了极大挑战.

3) 无人机系统信息处理高速化、智能化, 信息传递多样化, 传感器系统综合化, 增大了反侦察和干扰的难度.伴随深度学习、大数据的浪潮, 以人工智能为核心的无人机研究逐步开展, 并且成果显著.此外, 为增强无人机通信效率和抗干扰能力, 在其内部还安装了高速信息处理机, 信息处理速度得到很大提高.同时为了提高无人机的探测侦察能力, 许多无人机系统安装了由雷达、红外等多种异类传感器构成的传感器系统, 可进行准确的态势感知, 综合化水平越来越高.此长彼消, 这使得其侦察能力大大提高的同时, 也加大了对其进行干扰、欺骗、伪装的难度.

4) 无人机集群相关研究方兴未艾, 传统防空系统难以应对.相比于单个无人机, 集群无人机不仅作战效能高、灵活性强, 而且作战成本可控、效费比高, 近年来已成为各军事强国争先研究的一种新型作战样式.战场上, 集群攻击将使得作战成本极不对称, 效费交换劣势明显.除此之外, 随着技术的成熟, 集群式微型机亦发展迅速, 已成为美、俄、以等国军方重点关注的内容, 比如美国的小精灵计划.而随着复眼战术、蜂群策略逐步完善, 未来将出现更多的作战样式.

总而言之, 无论是无人机的外形逐渐隐身化、微型化, 还是系统一体化、综合化, 信息处理高效化, 抑或是作战方式集群化, 都使反无人机技术面临重重困难, 但也反映出反无人机研究势在必行.这些是挑战, 也是机遇, 将大大推动反无人机技术的发展.

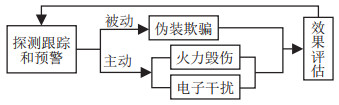

当前的反无人机技术体系主要由探测跟踪和预警技术、毁伤技术、干扰技术和伪装欺骗技术4大部分组成[1], 其作战过程如图 1所示.

|

图 1 反无人机技术体系 |

第1步是对无人机进行探测识别, 然后再根据实际情况, 选择对其进行欺骗干扰的软损伤还是火力打击的硬摧毁.除此之外, 己方须进行一定的伪装防护以降低敌方无人机的侦察效率和效果.从图 1可以看出, 探测预警技术是后3种技术的基础和关键, 并且由于各国反无人机技术都采取严格的保密措施, 能够查找到的公开技术有限, 而无人机作为一种检测目标, 对其进行探测和识别的公开研究较多.因此本文首先对无人机探测技术进行详细总结, 然后介绍其他3种对抗技术, 并简要介绍目前一些典型的反无人机系统, 最后针对集群无人机描述反制措施.

1 探测技术探测技术主要包括目标检测和识别.检测是指确认是否出现目标, 但昆虫或鸟类可能导致误报, 因此需要进行目标分类, 以便后续做出决策.经典的检测和分类算法可以描述为: 首先通过传感器获取目标信息, 然后通过信号处理方法进行目标检测, 进而从处理后的信号或图像中提取特征, 最后使用分类算法进行分类.表 1对目前国内外较为典型的探测系统从探测方式、功能方面进行了总结.

| 表 1 一些典型的监测控制类反无人机系统 |

通过表 1可以看出, 绝大多数反无人机系统主要通过雷达和光电(红外和可见光)传感器检测威胁, 而很少通过声波和无线传感器, 并且鲜有系统单独使用除雷达外的传感器对目标进行探测识别.由此可见, 雷达是应用范围最广的检测部件.因此, 本节主要对雷达探测技术进行较为详细的阐述, 而对其他探测技术简要介绍, 主要关注于最新的研究.

1.1 雷达探测技术雷达在海面以及陆地目标的监测预警方面担任了重要角色, 在无人机探测方面的研究占据较大比重.雷达探测可以描述为: 雷达向外发射电磁波, 然后对回波进行处理以获得目标信息.理论上, 这些信息主要包括: 距离、角方向、径向速度、外形、微多普勒特征等.目前的研究一是针对“低慢小”目标的检测, 二是无人机与鸟类的有效分类.

1.1.1 “低慢小”目标的检测“低慢小”目标主要是指飞行高度低、飞行速度慢、反射截面积小的一类目标, “低”使得雷达必须在复杂的背景和杂波的干扰下检测目标, 且在较为严重的多径效应和角闪烁效应下跟踪目标; “慢”使得雷达必须能够将慢速运动的目标与具有一定速度的地面杂波分辨出来.针对“低慢小”目标的检测, 本文主要从以下3个方面进行概述.

1) 杂波和干扰抑制技术.

这是雷达探测解决的关键性问题, 就雷达本身而言: 一是采用高分辨、低副瓣的天线波束; 二是采用高分辨距离单元, 因为距离分辨越小, 杂波的面积就越小; 三是采用宽发窄收技术, 实现速度高分辨.就信号处理方面而言, 在抑制杂波的同时还需减少回波信息的损失, 相关的算法主要有: 自适应处理技术[2]、基于知识辅助的方法[3]、检测前跟踪(detection before track, DBT)[4]等.其中时空自适应处理技术是常用方法之一, 但是由异类杂波组成的场景会破坏训练数据, 导致自适应杂波滤波器失配和检测性能下降[5].因此有学者提出将其与基于知识辅助的方法相结合, 文献[6]首先利用地形的先验知识构造初始干扰协方差矩阵和先验回波数据, 然后利用实际回波数据与合成数据之间马氏距离差异, 将数据分为纯部分和非纯部分, 以纯数据为训练样本, 重构了被测区域的干扰协方差矩阵.DBT算法也值得一提, 但该算法具有计算量偏大的问题, 为此文献[7]使用动态邻域跟踪目标, 与传统的跟踪前检测(track before detection, TBD)算法相比, 该算法所需的计算量更少, 并且能够提高检测性能.

基于传统算法, 一些研究做出了创新并且性能表现较好.文献[8]提出了基于稀疏字典学习的海杂波抑制方法, 首先使用优化的

2) 回波信号的精细化信号处理技术.

由于运动目标速度较低, 易受杂波和干扰影响, 进而造成目标检测性能低, 需要对回波信号精细化处理.比较典型的是动目标检测[11-12]和动目标显示[13]技术.对于动目标检测而言, 窄带滤波器是关键, 直接决定了最终的检测性能, 主要方法有快速傅里叶变换、FIR滤波器等.文献[14]先利用高阶FIR滤波器滤除低频杂波, 再使用Chirp-Z变换、Radon-Fourier变换和自适应匹配滤波器, 实现目标能量的融合聚焦, 提高信噪比, 最后利用单元平均恒虚警率检测器实现目标的检测, 极大地提高了检测概率.

3) 多径效应抑制技术.

多径效应具体是指雷达探测低空目标时, 发射的波束会经过多条路径回到接收机导致回波相互干涉, 进而导致幅度起伏、角度测量误差增大, 同时使雷达产生探测盲区.就雷达本身而言, 经典方法是分集技术, 主要有极化分集、频率分集等.就信号处理方面而言, 主要采用盲分离技术.文献[15]提出了一种称为two-step的两步分离算法, 先运用独立成分分析对复数形式的基带信号进行盲分离, 随后用线性相位解调技术恢复出各目标的运动信息.

综上所述, 雷达探测中, 基于“低慢小”无人机的探测主要通过信号处理方法实现, 国内外研究均做出了很大贡献.其中基于强杂波和干扰抑制的研究较多, 方法也各有不同.很多文献对原有的方法进行改进[6-7], 或将多种信号处理方法结合, 突破单个方法的限制[5-8].其中文献[8]使用基于稀疏字典的方法, 但遗憾的是未找到最佳参数.深度学习方法也得到了较好的应用[9-10], 其中文献[9]虽然证明了深度学习方法性能好, 但是主要基于仿真数据, 使用真实数据集结果如何还未可知, 并且匹配滤波和多普勒处理可以看作是卷积运算, 也可以尝试直接使用DNN检测原始回波.而文献[10]虽使用真实数据集, 但主要针对海杂波, 能否向其他类型数据泛化也未知晓.但这些研究充分说明了可以将深度学习方法应用于杂波抑制, 并且可能达到较高性能.此外, 针对回波信号的精细化处理和多径效应抑制技术研究较少, 该方面的研究仍需探索.

1.1.2 无人机与鸟类、无人机与无人机分类对于无人机/鸟类的分类问题, 依照分类特征的不同可以分为两个方向: 一是利用微多普勒签名的方法, 二是依赖于不同信息源的方法.其中利用微多普勒特征进行分类识别的研究占据大壁江山.

1) 基于微多普勒特征的分类方法.

微多普勒信号(micro Doppler signal, mD-s)是指目标或者目标构件微运动(比如鸟类翅膀扇动和无人机旋翼转动)时在其产生的雷达回波多普勒信号附近引入的额外调制边带.通过它所包含的信息可以反演出目标的形状、结构、姿态、受力状态、运动特性等相关特征[16].微多普勒签名已成功应用于许多自动目标识别任务, 例如飞机分类[17]、舰船检测[18]、人体检测[19]等.而在近几年的研究中, 微多普勒签名已成为无人机探测中一个热门的研究方向.

就时频处理方法而言, 目前的研究主要通过短时傅里叶变换(short-time Fourier transform, STFT)、经验模式分解(empirical model decomposition, EMD)获得mD特征, 其表现形式多为频谱图、倒谱图、声谱图和节奏速度图, 而由于mD-s是较高维的, 需要通过降维方法提取低维特征, 以减轻计算负担, 再进一步提取微多普勒特征, 最后进行分类.文献[20]通过希尔伯特-黄变换将mD-s分解为单独的信号, 然后对mD-s应用加权函数进行过滤和对齐, 并通过STFT和奇异值分解方法(singular value decomposition, SVD)提取mD特征, 使用线性和非线性的支持向量机(SVM)以及朴素贝叶斯(naive Bayes, NB)对鸟类和四类无人机进行分类, 分类精度达到92

尽管STFT已在mD-S分析中得到广泛且成功的应用, 但众所周知, 其时频分辨率较低.为解决此问题, 文献[21]提出了平滑伪Wigner-Viller分布(smooth pseudo Wigner-Viller distribution, SPWVD), 在执行SPWD之前将其应用于原始信号, 然后利用SVD方法和倒频谱分析提取mD特征, 这可以在估计叶片长度和叶片闪光频率分量的数量方面获得比STFT更高的分辨率.解决该问题的另一种尝试是EMD方法.文献[22]使用EMD方法去除杂波分量, 然后利用STFT生成频谱图, 通过主成分分析(PCA)进行降维.将66个类别无人机使用

以上文献mD-S表示形式都放弃了相位谱, 而只使用幅度谱, 这将会丢弃一些重要的判别信息.文献[24]提出了正则化的二维复对数-傅立叶变换解决此问题, 并且提出子空间可靠性分析(SRA)方法去除不可靠特征维, 该方法将错误率从6.68

就分类方法而言, 除了使用经典的分类器, 一些学者也对其他分类方法进行了探索.文献[25]通过核主成分分析(kernel PCA, KPCA)方法减小特征向量的维数, 使用改进的Ada\_MCBoost分类器, 修改了损失函数, 通过纠错输出码将多类别分解为一组二进制类的方法, 直接完成了多类识别问题, 但该方法计算量大.文献[26]将增强分类器用于UAV的检测和分类, 将30个回归树的弱分类器组合在一起成为一个增强型分类器, 对鸟类和两类无人机进行分类, 分类精度远高于SVM.一些学者也应用深度学习方法进行分类.文献[27]通过使用STFT和Wigner-Ville分布进行联合时频分析将mD-s转换为图像后, 基于深度卷积神经网络(deep CNN, DCNN)对无人机进行分类; 文献[28]将DCNN直接应用于原始微多普勒频谱图, 提出的DCNN能够自动学习特征, 无需引入任何领域背景知识.

2) 基于目标回波与其他运动特征的分类方法.

该方法检测到目标后, 同样经过一系列的信号处理法提取飞鸟和无人机的其他特征, 比如RCS特征、高分辨距离像特征、极化特征等, 然后再进行分类.与基于mD-s的研究相比, 基于上述特征的相关文献较少, 这是因为相比于mD-s, 很多特征不明显且较难获取, 会导致最后分类效果不佳.

文献[29]从原始信号中提取了9个极化参数来区分大型鸟类和无人机.实验表明, 使用极化特征也能在无人机与鸟类之间实现良好的分离.文献[30]提出了一种基于多信号分类(MUSIC)算法的超分辨率范围轮廓和中心矩特征的识别方案, 利用多信号分类算法生成超分辨距离剖面, 应用PCA以消除其冗余, 将贝叶斯分类器组合在一起对5类无人机进行分类, 但该方法计算复杂度高.在深度学习算法方面, 文献[31]从雷达动目标回波中提取多普勒频移信息, 然后利用STFT转换为时频图, 最后利用CNN进行检测和分类; 文献[32]利用多普勒信号及其频谱相关函数(spectral correlation function, SCF)对微型无人机系统进行自动检测和分类, 首先使用快速傅里叶变换(FFT)对SCF图像进行处理, 然后使用深度信念网络(deep belief network, DBN)对无人机分类; 文献[33]基于雷达特征、运动学信息和基于速度的信息创建一组手工制作的特征, 然后使用SVM方法进行分类; 文献[34]使用FFT方法和聚类方法从检测目标的距离剖面和距离多普勒矩阵获得雷达相关特征, 基于两个一维的CNN目标检测架构进行检测和分类, 通过真实数据验证该模型的总体分类准确度为95.0

| 表 2 基于雷达探测的不同特征及不同分类方法比较 |

从表 2可以看出, 大部分研究分类准确性在90

利用mD-s是最常用的方法, 但是目标的易失性使得可靠提取mD-s变得困难, 并且大部分的工作是在理想场景下进行的或是使用模拟数据[20-21, 23, 26]. 实际上, 许多文献仅研究了通过微多普勒签名进行目标识别, 迄今为止还没有完整的基于自动分类的无人机检测框架发布.基于其他特征进行分类的研究[29-34]也取得了很大进展, 但是与基于mD-s的方法相比, 这方面的研究还不够完善, 分类准确率也不够高, 有待进一步研究.除此之外, 由于各文献使用数据集不同, 不能在同一尺度上进行比较, 亟需公开可用的雷达检测数据和分类数据集以供研究人员开发和评估他们的方法.

1.2 其他辅助探测技术 1.2.1 红外探测红外探测原理是利用背景与目标之间的红外辐射差进行目标识别.红外探测获取的是目标和背景图像, 通过一系列图像处理技术可对目标进行探测和识别, 其中最主要是噪声削减以及背景抑制.传统的处理方法一般分为DBT算法和TBD算法, 将这两种算法与粒子滤波结合在一起得到了广泛应用[35-36].目前红外探测方面的研究主要集中在基于传统方法的目标检测和基于深度学习的处理方法.

1) 基于传统方法的目标检测.

随着无人机的微型化发展, 对于红外探测而言, 其主要难点是“小目标检测”.相关的图像处理方法包括空域滤波方法(高通滤波方法、中值滤波方法、形态学的方法等), 变换域滤波方法(频域、时域滤波方法、边缘分割方法等).在许多研究中将以上方法结合使用.文献[37]首先使用建议的局部对比度度量获取图像的局部对比度图, 实现了目标信号增强和背景杂波抑制, 然后采用自适应阈值分割目标; 针对复杂背景下红外小目标难以检测的问题, 文献[38]提出了基于多尺度融合滤波的目标检测算法, 该算法结合空间多尺度分解滤波和时间多尺度差分处理, 可以有效克服复杂的低空背景干扰、未知目标尺度和目标低信噪比等难题; 文献[39]提出了一种基于人类视觉系统对比机制的改进算法, 首先利用高斯拉普拉斯滤波器处理输入图像, 增加目标与背景之间的对比度, 然后使用形态学方法在所有方向上对滤波后的图像进一步滤除杂波, 最后通过局部阈值分割方法处理图像, 获得真实目标.

2) 基于深度学习的处理方法.

目前, 最新和热门的红外图像处理方法是基于深度学习.首先通过传统图像处理方法获取目标候选区域, 然后利用深度学习实现目标的检测、自动特征提取, 也可以直接将深度学习方法应用于原始图像.反无人机是一个新兴领域, 目前基于深度学习方法的无人机红外探测研究很少, 但对其他目标研究较多, 可以借鉴这些成果将其应用于无人机.

文献[40]利用回归型的DCNN进行背景成分抑制和潜目标增强, 通过阈值分割法提取候选目标区域, 最终送入DCNN进行目标确认; 文献[41]使用来自红外帧的恒定阈值生成候选车辆, 通过基于最大距离的局部自适应阈值方法生成轮廓, 从而减少了分类处理区域的数量并降低了误报率, 最后应用于DBN验证车辆候选者, 检出率为93

综上所述, 在红外小目标探测方面有许多优质文献, 虽然各类方法不同, 但大都可以描述为首先使用图像处理方法抑制杂波和背景, 再进一步运用分类方法、阈值分割、滤波等算法检测或跟踪目标.由于检测过程中可能存在尺度变换问题, 文献[38]所提方法值得借鉴, 在此基础上, 未来的研究可以考虑加入人工智能方法, 提取更深的特征用于目标识别.在深度学习算法方面, 主要是基于CNN的研究, 并且很多研究使用VOT-TIR数据集进行验证[43-44], 或者针对于车辆检测[41], 值得一提的是文献[42]数据集由从不同红外传感器(中波和长波)获得的不同视频记录收集的红外目标船/舰、坦克、飞机和直升机组成.虽然上述这些目标主要特征与无人机有很大的不同, 但是如果目标可见, 则这些方法也应适用于无人机.因此, 如何将此类方法应用于无人机探测仍需相关学者和研究人员的积极探索.

1.2.2 可见光探测可见光探测主要通过处理图像或视频估计目标物体的位置和身份.这是一个非常成熟的研究领域, 对于图像和视频的检测框架都已基本确立.目前研究主要集中于车辆检测、行人检测、目标识别及分类等领域.而在无人机探测方面的研究较少, 主要因为该方面的公共数据集较少, 目前一是使用与其他传感器融合的方法提高检测性能, 二是使用深度学习方法处理.

1) 与其他传感器融合.

由于可见光不能获取目标的距离信息, 并且易受光照影响, 许多研究是将红外与可见光图像融合、雷达与可见光传感器融合进行无人机探测.特别对于图像融合, 目前深度学习方法应用较广, 并且成果显著.文献[45]对21对可见光和红外源图像首先通过图像分解获得图像的基础部分和细节内容, 然后使用加权平均策略融合基础部分, 再使用VGG-19提取深层特征, 通过多层融合策略获得权重图, 最后通过这些权重图和细节内容重构融合的细节内容, 与基础部分生成融合图像, 这个方法还可以应用于其他图像融合任务, 例如多曝光图像融合和多焦点图像融合; 文献[46]提出使用生成对抗网络融合红外和可见光图像, 将该融合描述为保持红外热辐射信息与保存红外热辐射信息之间的对抗博弈, 网络由生成器与鉴别器组成, 均使用一个5层的CNN, 生成器生成具有主要红外强度以及附加可见梯度的融合图像, 而鉴别器则强制融合图像具有更多纹理细节; 文献[47]研究了一种低空目标的雷达/可见光协同监视跟踪方法, 将雷达作为主跟踪器, 可见光传感器作为检测器, 通过交互多模型算法和学习器实现量测模型切换和数据在线更新, 从而获取更准确的目标状态信息.

2) 基于深度学习的可见光探测方法.

随着深度学习的蓬勃发展, 深度学习方法尤其是CNN在目标检测方面表现出卓越性能, 鉴于此, 基于深度学习方法的可见光探测也逐渐在无人机探测方面占据了一席之地.目前存在的问题是公开的UAV可见光图像数据集较少, 而深度学习需要大量数据进行训练.因此, 文献[48]开发了一种基于模型的无人机增强技术, 该技术使用常规图像处理方法和3D渲染算法, 可以自动生成带有边框标记的无人机图像, 使用Faster-RCNN作为检测器, 多域网络作为跟踪器, 并利用图像序列中的残差信息对多域网络进行训练和测试, 提高跟踪精度; 文献[49]使用网上抓取的图像(包括鸟类、UAV和背景照片)生成了一个广泛的数据集, 基于VGG的网络进行目标检测; 类似地, 文献[50]从公开的图像中提取背景, 并将真实的无人机和鸟类与不同的背景视频相结合, 创建了一个人工数据集, 然后应用基于CNN的端到端对象检测模型对目标进行检测.

文献[51]使用了ResNet-101、Faster- RCNN以及单发检测器模型(single shot detector model, SSD)分别对Bird-Vs-Drone项目提供的UAV和飞鸟数据集进行检测分类, 实验表明, ResNet-101的Faster R-CNN在训练和测试数据集上表现最佳; 文献[52]针对当UAV逐渐消失时是否能够进行准确的检测问题, 纳入超分辨率技术, 使用具有跳过连接和深度残留的CNN模型首先对图像放大2倍, 然后使用Faster-RCNN对目标进行检测; 文献[53]提出了一种基于CNN的时空语义分割方法, 通过使用U-Net架构识别较大图像中感兴趣的区域, 从而解决了检测非常小的目标问题, 然后使用ResNet分类网络确定这些区域是否包含UAV.

综上所述, 目前最成功的方法集中在深度学习方面, 但需要解决数据集较少的问题, 一些研究方法值得借鉴[48-50].文献[51]比较了Faster-RCNN和SSD来解决UAV检测和分类问题, 两者均以Inceptionv2作为其骨干网络体系结构, 结果显示Faster-RCNN具有更好的准确性, 但SSD更快.仅当对象很大时, SSD才是一个不错的选择.除此之外, 鉴于目前图像处理领域的成功, 未来应该将现有的通用目标检测方法应用到无人机数据集中, 比如纳入超分辨率技术[52]或时空语义分割方法[53]来提高探测性能, 从而避免小目标造成的误报.

1.2.3 音频探测音频探测是指利用UAV运动时其内部构件运动产生的“音频指纹”进行探测.单独使用声传感器对UAV进行探测的研究很少, 其一般作为雷达和可见光探测的有效辅助手段使用.音频探测易受环境噪音和探测距离影响, 多数无法评估超过150m的距离, 其次UAV声音的公共数据集很少, 因此很少学者对其进行研究.目前主要使用梅尔频率倒谱系数(Mel frequency cepstrum coefficient, MFCC)、线性预测倒谱系数(linear prediction cepstrum coefficient, LPCC)、机器学习等方法进行特征提取, 然后使用SVM、深度学习算法进行分类[54].

文献[55]使用MFCC、LPCC进行特征提取, 然后采用具有各种内核的SVM从嘈杂环境中的鸟、飞机和雷暴等各种声音中检测和分类无人机声音, 实验结果表明, MFCC方法优于LPCC方法, 检测的准确性约为96.7

文献[57]第1个研究了高噪声真实环境中的UAV声音检测, 为弥补训练数据的不足, 在无人机声音数据集中添加各种环境声音数据进行扩充, 然后使用GMM、CNN和循环神经网络(RNN)对无人机进行检测, 最终得出结论: CNN模型性能最差; GMM模型性能稍好, 但即使引入其他训练数据也不能显著改善GMM模型的性能; RNN性能最好, 并且可以通过各种背景训练数据集, 提高其精度性能.文献[58]提出了一种由30个高清摄像机与3个麦克风组成的带有音频辅助功能的摄像机阵列, 将视频与音频相结合, 使用40

综上所述, 上述研究的主要局限性在于UAV音频数据集的缺失以及距离的限制, 因此, 一方面需要加紧创建UAV音频公共数据库; 另一方面还应该积极探索无人机距离的增加对检测性能的影响.值得一提的是, 鉴于深度学习在语音识别领域的成功应用, 文献[57]也将CNN和RNN应用于真实无人机声音的识别, 并得出RNN性能最好的结论, 未来可以考虑将其他方法(如长短时记忆网络等)应用于该领域.为了充分发挥音频检测优点并克服其缺点, 还可尝试与其他探测方法结合, 文献[58]将音频、视频结合, 结果显示此方法可以显着提高检测框架的性能, 该方面研究也值得进一步探索.

1.2.4 无线探测无线探测是利用无人机进行通信时的无线电信号进行无人机识别和定位.具体而言, 是采用射频识别技术监测无人机传输信号, 然后提取这些信号的频谱特征并构建一个无人机特征库, 实现无人机目标的检测, 最后使用到达时间法[59]、到达时间差以及无线电测向技术[60]等对无人机进行定位.在近几年的研究中, 主要应用SVM、遗传算法、聚类算法以及深度学习方法进行特征提取及最终分类.

在传统机器学习算法方面, 文献[61]利用SVM识别无线电信号, 通过多项式搜索算法对具有多项式核函数的SVM进行优化, 并选择该分类器作为识别无线电信号分类器, 与遗传算法相比, 该方法在识别无线电对地干扰信号方面具有更高的准确性和鲁棒性; 文献[62]开发了一种新颖的典型频谱方法分析广播频段中的频谱数据, 首先基于重复实验提取了6个相关特征, 然后基于聚类算法构建典型频谱, 在此基础上引入压缩频谱数据和识别干扰源, 并根据典型的静音信号频谱识别非法广播, 这对无线电监测的进一步研究具有指导意义.

近年来, 将深度学习方法应用于无线电检测也备受关注.文献[63]基于Choi-Williams时频分布将图像特征获取到CNN中, 首先使用Choi-Williams时频分布变换将信号变为时间和频率的二维图像, 然后利用图像二值化和图像去噪算法将二维图像处理为二进制图像, 最后使用一个6层的CNN进行特征提取和分类, 该系统在高噪声环境中对8种认知无线电波形进行分类, SNR

以上研究虽然都不是基于无人机探测, 但是其处理方法值得借鉴.其中, 文献[62]虽然取得了较大成功, 但是其算法的增量贡献有待改进; 文献[63]将CNN成功应用于无线电波形分类, 但是提出的方法适用于单样本分类, 不适用于多个样本, 而每时每刻在空域中都有许多波形, 如何实现复杂的多个样本的分类值得研究人员积极探索; 虽然文献[64]实现了对31类信号分类, 但使用仿真数据进行验证, 应用到真实空域性能如何还未知, 可以知道该方法高于某些传统的机器学习方法, 并且该方法采用一维卷积, 从而大大降低了复杂性, 这与无线电信号特性相符, 它与文献[63]从两种不同的角度对原始无线电信号进行处理, 究竟是一维信号还是转换为二维图像更适合基于无线电信号分析值得探讨.

1.2.5 融合探测基于多传感器融合的无人机探测可以描述为: 将两个及两个以上的传感器进行数据融合, 以得到更多更精确的信息, 突破单传感器探测的局限.

近年来, 许多学者将多传感器融合进行目标检测, 主要组合形式为雷达与红外、雷达与可见光、可见光与红外.文献[65]融合了雷达、红外搜索和跟踪的数据, 分析了5种数据融合方法, 包括贝叶斯融合、基于信号方差的融合、最优融合、基于误差方差的融合和基于扩展卡尔曼滤波器的融合, 结论是基于扩展卡尔曼滤波器的融合具有最佳的跟踪性能; 文献[66]将激光雷达与红外传感器进行融合实现对高速低空目标的3D定位, 其中卡尔曼滤波器和扩展卡尔曼滤波器用于最佳状态估计和数据融合, 该融合发生在决策级; 文献[67]使用引导滤波和动态范围压缩自适应地增强可见图像, 同时将红外像素值作为指标因子, 对可见图像进行指数变换以提取红外特征信息, 最后采用基于导引滤波器的混合多尺度分解方法对图像进行融合, 该融合发生在特征级; 文献[68]提出了一种基于DS证据理论的红外与可见光融合的方法, 对目标进行检测, 将特征提取算子应用于分别获取特征的红外图像和可见图像后, 以红外图像和可见光图像的局部方差偏移、局部方差对比和局部熵为证据, 在特征级通过DS组合规则进行融合.

也有研究融合了两类以上的传感器进行目标检测, 主要面临的问题在于数据维度的增加如何有效保证实时性.文献[69]将声学、红外摄像机和雷达3类传感器融合对鸟类进行监测, 对各传感器获取的数据进行预处理, 其中声传感器主要进行特征提取和分类, 使用基于信号处理的不同特征提取技术导出信号的重要信息, 使用进化神经网络进行分类.对于红外进行特征提取, 使用背景减影、斑点检测、阈值化和噪声抑制执行红外图像处理; 对于雷达, 使用粒子滤波器预测目标的下一个位置.在融合阶段, 使用了两级融合层次结构, 其中红外和雷达在特征级进行融合, 得到的特征融合向量在决策层与声音数据使用模糊贝叶斯方法进行融合.

1.3 各探测方法性能分析及对比综上所述, 低空空域的无人机探测技术表现出3大特点: 强对抗性、强实时性、高碎片性.强对抗性是指UAV低可观测以及运动特征迷惑; 强实时性是指低空域局势瞬息万变, 要求探测手段反应速度快并能及时处理数据; 高碎片性是指低空域信息维度广、信息粒度差异大, 需进行聚合、重构和融合以挖掘出有价值的信息.本文已经在1.1节、1.2节对基于雷达、可见光、红外、音频、无线信号和多传感器融合的无人机探测方法研究现状进行了综述.下面对上述方法从性能、优缺点等方面进行分析总结.

1) 雷达探测.该方法检测性能较高.在优缺点方面, 它能够全天候工作, 受天气影响较小, 并且是唯一能够远距离探测目标的方法, 但它获取的目标信息不够精确, 易受到电磁干扰.其目标检测主要通过经典的雷达信号处理方法实现.主要难点是“低慢小”目标的检测, 相关方法主要是进行强杂波及背景、多径效应抑制等.相对于目标检测, 无人机分类是一个更加活跃的研究领域, 并且大多数研究已通过从其他自动目标识别问题移植而来的既有技术的转移而获得成功.

2) 红外探测.该方法检测性能高.在优缺点方面, 其能全天候工作, 并获取角度信息, 具有很强的抗干扰能力, 但是易受不利天气的影响并且造价较高.目前红外探测的研究主要是针对小目标, 这也是该领域的研究难点之一, 在该领域利用CNN进行目标检测和分类效果显著.因此, 随着高分辨红外设备成本逐渐降低, 基于深度学习的红外探测方法未来可期.

3) 可见光探测.该方法检测性能高.可见光传感器成本低, 成像分辨率高, 纹理特征明显, 但是容易受到光照影响, 其面临最大挑战是误报率高和与天气相关的问题.由于难以区分无人机和类似大小的物体(如鸟类), 误报率会较高.而受到天气和光照影响的问题可以通过红外技术的补充缓解, 因此许多研究将红外与可见光融合, 这是目前的研究热点之一.

4) 音频探测.该方法检测性能较低.其主要优点是重量轻, 易于安装, 缺点是探测距离短, 易受噪音影响.目前机器学习算法在该领域得到了较为成功的应用, 可作为一种辅助手段用于无人机检测问题.

5) 无线探测.该方法检测性能较低.较其他探测方法主要优点在于能从截取的控制信号中分析出无人机的飞行状态和操作员的部分信息, 但不能对不发射无线信号的无人机进行探测.此外, 在实际环境中, 还存在许多其他无线信号与无人机共享频带.

6) 融合探测.该方法检测性能高.在优缺点方面, 融合探测将各类传感器数据融合进行优缺互补, 使得监测系统能够全方位、全时段工作, 可得到更精确的结果, 容错性高、覆盖更广.而由于不同传感器实际获取数据是异构、零散、片段、弱关联甚至冲突和矛盾的, 目前亟需找到一种有效的方法合并来自多个来源的信息.此外, 多传感器可能造成系统复杂度高、能源消耗大, 须在检测性能与能源消耗间找到平衡.

2 无人机对抗(反制)技术 2.1 对抗技术分类为了达到较高效费比, 以免出现“大炮打蚊子”, 根据目的和目标的不同, 可以采取不同的无人机对抗技术.经典的对抗技术主要分为以下3类.

1) 伪装欺骗技术.对己方进行伪装以欺骗敌方无人机, 使其无法接收或接收到错误的信息, 有效降低其侦察效率和监视效果.

2) 干扰技术.利用光电对抗、数据链干扰、控制信息干扰等技术对无人机的通信、动力系统以及自动驾驶与控制系统实施有效干扰使其失联失控, 降低和削弱其主要作战和执行任务的能力.相比于其他两种技术, 干扰技术可以大角度大面积实施, 并且能够同时应对多种类、多数量的目标, 作用距离较远.

3) 毁伤技术.其使用武器装备对无人机进行硬摧毁, 主要是基于导弹、激光武器、微波武器等新概念、新机理武器以及格斗型反无人机技术、常规火力毁伤.其中, 激光武器和微波武器受到各国高度重视和大力发展, 比如美国就将以激光武器为代表的定向能武器作为反无人机作战系统发展的核心项目.

以上3类对抗技术各有优点, 但在作战的过程中, 往往软硬兼施, 构建一个层层抗击、布势合理的反无人机作战力量体系[70].经典的对抗技术需要依靠人工的决策和实行, 而随着人工智能的迅速发展, 各国也在慢慢探索如何将其应用到反无人机系统中, 以实现数据分析、语义推导和智能决策.特别是将人工智能技术应用到无人机探测中, 能够极大地提高检测概率和识别率.比如美国黑睿公司的UAVX系统就应用了人工智能技术, 利用人工神经网络对无人机进行自动分类, 以降低误警率.俄罗斯将人工智能应用到防空模块中, 其控制面板在接收数据情报信息后会快速对目标进行判别, 并通过智能决策判断是否对捕捉目标进行打击.文献[71]中指出, 未来的反无人机系统还应具有学习、思考和理解物理世界和社交世界的能力, 他们设想启用认知-物联网为系统提供“大脑”以实现高级智能.

2.2 反无人机系统分类及研发现状反无人机系统是指利用上述反无人机技术手段对无人机进行监测、干扰或者摧毁的一种装置.根据应用技术和功能的不同, 可以将反无人机系统分为监测控制、毁伤抓捕以及干扰阻断3类[72], 但多数反无人机系统内部都有探测识别系统, 逐步实现探测-防御-攻击一体化.在表 3中对3类反无人机系统优缺点进行了总结.

| 表 3 各类反无人机系统优缺点比较 |

1) 监测控制类.

此类系统在监测方面主要利用雷达、光电等传感器对有效范围内的空域进行实时监控.在控制方面通过劫持无线电、GPS定位欺骗、网络攻击等方式实现对无人机的控制.在表 1中已经列举了国内外目前较为典型的部分监测控制类系统, 可以看出, 大多数监测控制类反无人机系统已经实现了探测、干扰一体化, 少数系统仅仅拥有探测能力.

2) 毁伤抓捕类.

此类系统主要是采用导弹、微波武器、激光武器等多种打击手段, 对无人机进行拦截、摧毁或捕获, 打击效果好, 风险系数低, 且不易受干扰.但是, 此类系统造价昂贵、内部结构复杂, 有些手段比如导弹等在击打无人机时可能造成附带损伤, 主要应用于军事领域, 不适用于民用.以我国工程物理研究院研制的“低空卫士”为例, 其主要使用非可见光波段的激光, 可在5s内击毁目标, 并且不会有附带损伤, 单套系统防卫面积达12km

| 表 4 一些典型的毁伤抓捕类反无人机系统 |

3) 干扰阻断类.

其工作原理是向无人机发射定向大功率干扰射频, 以切断无人机与遥控平台之间的信号, 从而迫使其降落或返航.除此之外, 许多系统也采用电磁脉冲、

高能微波等方式使其电子元件失效、半导体元件烧毁, 从而无法执行任务甚至坠机.此类系统主要优点在于成本较低、操作简单且易于携带, 易于后续的调查取证.表 5列举了国内外典型的干扰阻断类系统.从表 5可以看出, 目前大部分干扰阻断类系统以无线电干扰、GPS中断为主, 少量使用电磁脉冲、高能微波等.但无线电干扰方式对干扰频段外的无人机无效, 而全频段干扰费用高, 且尚无成熟产品.

| 表 5 一些典型的干扰阻断类反无人机系统 |

综上所述, 美国依靠其技术优势研发了各种类型的反无人机系统, 使其反无人机能力处于国际领先水平, 其他国家也加紧步伐, 各类系统层出不穷, 有力推动了反无人机技术和装备的飞速发展, 呈现出多样化、专业化、智能化和低成本化.但各类系统都有一定局限性, 只能针对特定环境执行反无人机任务, 能够完全实现全要素的防护与压制的系统正在研发, 还未正式投入使用, 比如法国的“ANGELAS”、英国的“AUDS”.而近年来, 也出现了一些综合的系统, 不仅能实现探测识别, 还能选择软损伤还是硬摧毁, 如以色列的“无人机穹”.可以预测, 未来反无人机系统研究将朝着一体化、智能化、体系化发展.

2.3 反无人机集群无人机集群是指由多架无人机通过分布式控制技术集合在一起执行相同的任务.未来, 无人机集群作战将成为战场的重要作战形式.有矛必有盾, 研究如何有效对抗无人机集群势在必行.

即使是无人机集群, 其探测技术也是基于雷达、可见光等传感器, 当无人机集群分布较为分散时与探测单架无人机区别不大, 需要解决的问题是分布较密集的情况[73].由于无人机集群研究也刚起步不久, 目前国内外对无人机集群的探测技术研究较少.较为典型的反无人机集群系统是美国X-MADIS系统.针对无人机集群的特点, 有以下几种对抗措施.

1) 区域拒止策略.此类策略需要较为有效及时的探测系统, 从而及时预警.一是捣毁“蜂巢”/“鸟巢”, 及早发现无人机集群的运载平台, 在根源上阻止无人机集群; 二是捣毁控制站, 搜索无人机与控制站的通信信号后, 首先确定控制站位置, 然后对其实施精准打击, 从根源上切断集群无人机的通信, 使其失控.

2) 软对抗.这主要针对集群无人机个体之间必须依靠通信系统共享信息的特点.一是电子干扰, 集群大都通过无线电通信、GPS组织编队飞行, 故实施电子干扰能使无人机失控; 二是控制劫持, 对集群进行针对性的压制、干扰, 利用网络攻击技术, 向集群的控制系统注入控制指令或病毒, 进而俘获或使其自毁.但是, 若对方无人机集群放弃远程信息交互, 采用自主方式攻击, 则这类方法也许难以奏效.

3) 硬损伤.主要包括点杀伤和面杀伤.点杀伤方面: ①利用舰载直升机航炮进行拦截; ②使用定向能武器进行打击, 比如高能激光; ③电磁散弹炮等新型高射速防御武器拦截; ④采用“密集阵”等传统近防武器拦截.面杀伤方面: ①使用高功率微波武器, 击穿和烧毁电子元器件, 使目标失控甚至坠毁, 这是目前各国发展的关键技术之一, 能够有效对付无人机集群; ②利用大杀伤的防空导弹; ③采用抓捕型拦截武器, 这也是有效的手段之一.

4) “集群”对抗“集群”.未来随着智能化水平的提高和集群研究的不断深入, 集群无人机将变得高度自主智能, 上述这些措施对抗效果将变得十分有限.美国海军研究生院提出, 在未来的战争中, 唯一能对抗集群无人机的将是另一群无人机.

总而言之, 无人机集群作为数量庞大、机动灵活、自组织性强的作战群体, 采用单一手段对抗效果将十分有限.反无人机集群应当做到软硬结合, 关注于体系对抗, 综合运用多种手段和措施.还要特别注意发展集群对抗集群的手段.

3 结论与展望 3.1 结论随着无人机产品的广泛应用, 反无人机作为国家安全、公共安全的保障之一, 受到众多研究学者以及军事强国的密切关注和研究.本文总结了目前反无人机技术的研究现状, 以让读者全面了解反无人机领域中围绕探测技术、伪装技术、干扰欺骗和毁伤技术以及反无人机集群等方面已经取得的研究成果以及未来的研究前景和发展方向, 使得反无人机技术的研究迈向一个新的台阶.

探测技术作为反无人机技术的关键, 具备了强对抗性、强实时性、高碎片性.国内外对其进行了大量研究, 并且成果显著, 但无人机数据集的缺乏、算法应用的广泛性等原因阻碍了它的快速发展.在本文中, 将探测技术分为雷达、可见光、红外、音频、无线、融合探测6类, 并对每一类的探测技术的研究热点与难点进行了分析和总结.在无人机对抗技术方面, 将其分为3类: 伪装欺骗、干扰技术、毁伤技术.目前美国在该方面处于领先地位, 但其他军事强国紧跟其后, 使得对抗系统的研究逐步多样化、专业化和低成本化, 并向一体化、智能化、体系化迈进.本文还对各类对抗技术的主要方法和优缺点进行了归纳总结, 然后介绍了3类反无人机系统, 并列举了一些典型的反无人机系统, 从打击方式、干扰手段、作用距离等方面进行了比较.除此之外, 鉴于目前无人机集群的迅速发展, 反无人机集群越发重要.本文对相关的对抗技术进行了分析与归纳, 但相对可靠的方法依旧是集群对抗集群、无人对抗无人.

3.2 研究前景从无人机的探测预警到各类反无人机系统, 近代的研究学者均做出了很大的贡献, 极大促进了反无人机领域的发展.尽管如此, 该领域仍然存在一些尚待解决的开放研究问题, 并且随着社会的发展, 新的挑战将不断产生.目前存在的问题如下.

1) 缺乏无人机签名数据集, 现实环境更为复杂.

各类探测技术如今虽然取得了较好的成果, 但研究都有所限制, 主要是因为无人机相关公共数据集较少, 因此迫切需要收集现实世界中的无人机音频、视频、图像等的数据集, 以作为研究人员开发相关算法的基准.除此之外, 许多研究基于模拟场景, 实验环境较为理想.而现实环境更为复杂, 有着强烈的不可控性, 未来的研究应当更加联合实际.

2) 控制射频干扰信号的发射功率.

无线干扰设备在干扰UAV及其控制器之间的通信的同时, 也可能会干扰到周围的无线通信.如何控制射频干扰信号的发射功率, 从而在不干扰周围无线通信的情况下有效地反制UAV仍需深入研究.

3) 权衡准确性和实时性、虚警率和漏报率.

检测的准确性是无人机探测的基本要求, 而准确的检测通常很耗时, 该问题的解决可考虑最优停止理论.与此同时, 较高的检测率要求传感器更加灵敏, 而过于灵敏的检测会造成较高虚警, 导致资源浪费甚至系统瘫痪, 不够灵敏又会产生大量漏报, 影响最终决策, 两者的平衡依旧是一个难题.

4) 多无人机检测、识别、跟踪和定位.

目前的研究大都停留在反制少数无人机层面, 当只有少量无人机出现时, 现有的大多数反无人机系统都可以应对.而随着无人机逐渐低成本化, 未来无人机可能会成群出现, 而目前的研究针对多无人机检测、识别、跟踪、定位还未有具体解决方法.

5) 反无人机系统的适用性.

很多现有的反无人机系统都是为特定的无人机或场景、军事或民用目的而设计, 比如许多无线干扰只对特定频率的无线电有用, 这限制了它们的应用和推广, 如何提高反无人机系统的适用性是个难题.

下面对该领域的发展趋势进行探讨.

1) 基于深度学习的多传感器融合探测.

无人机检测的结果不应该仅仅是音频、图像、雷达等监视结果的简单组合, 否则将丢失大量信息.深度学习善于从多源异构数据中提取复杂特征, 基于深度学习的多传感器融合的无人机探测与识别技术将会成为探测预警技术的发展趋势之一.首先, 通过深度学习网络对各传感器的数据进行处理, 以用于无人机检测和分类.然后, 可以将每个单峰深度神经网络产生的单峰警报信号通过深度学习网络融合, 得到最终决策, 实现无人机目标的探测、精确识别和持续跟踪, 从而提供清晰准确的态势信息.除了深度学习之外, 从特征融合和决策融合的角度, 开发可靠的技术来融合多传感器信息依旧具有重要意义.

2) 节能传感器协调.

多种监视技术会带来冗余信息, 这将会导致高能耗、高通信量和计算量, 缩短系统的循环周期和使用使命.不必让所有传感器始终时时刻刻工作, 可以通过无人机系统中的动态传感器进行协调.

3) 构建陆、空、电磁和网络一体化信息感知网, 形成察打、攻防一体化系统.

反无人机应贯穿侦、控、打、评全过程.现如今大都采用探测与对抗结合, 首先利用探测系统对无人机目标进行探测, 然后使用干扰或摧毁类系统进行拦截.这种工作方式要求至少两套反无人机系统以及它们之间信息交换系统的配合, 这将会造成实时性差、不便于部署等问题.未来随着无人机探测和对抗技术的发展, 上述各类系统有望实现小型化, 通过合理配置不同平台的雷达、光电、电子侦察等手段, 以形成覆盖远中近、高中低的多层次、全方位立体感知体系, 并最终融合为察打、攻防一体化系统, 这将是未来反无人机系统技术发展的重要方向.

4) 基于人工智能的无人机对抗技术.

目前人工智能已逐渐应用于无人机对抗并取得良好的效果, 基于人工智能的无人机探测技术能够有效提供关于无人机的方位、尺寸、类别等信息, 利于决策, 将成为未来探测预警技术的核心.而随着技术的发展, 特别是将人工智能融合进察打、攻防一体化的反无人机系统将成为反无人机领域重点发展方向, 在未来战场中, 以无人对抗无人, 以智能对抗智能的方式应对无人机的威胁将成为主流.

5) 有效利用先进技术以及新概念、新机理武器.

在新概念方面, 可以合理利用赛博控制技术和5G资源.许多无人机采用无线网络和远程开放端口进行交互, 因此可以利用赛博空间上的控制技术实现对入侵无人机的反制.目前, 5G正逐步融入人们生活, 与前几代移动网络相比, 5G网络将有飞跃发展.因此可以借助5G信号塔获取全向空域信号源, 这将大大减少监控探测成本.在新武器方面, 要充分利用信息时代高新技术, 尤其是定向能技术, 以研制更加有效的激光、微波等新概念、新机理武器, 这也是未来战争中反制无人机的有效手段之一.

总而言之, 反无人机是一个涉及面广、保密性高、有众多挑战的领域, 也是一个富有研究前景的领域.未来只有在理论上有所突破, 技术上有所发展, 手段上有所创新, 才能进一步推动反无人机技术的重大发展.

| [1] |

刘玉文, 廖小兵, 蒋明, 等. 反无人机技术体系基本框架构建[J]. 四川兵工学报, 2015, 36(10): 18-20. (Liu Y W, Liao X B, Jiang M, et al. Basic frame constructing of counter UAV technique[J]. Journal of Sichuan Ordnance, 2015, 36(10): 18-20.) |

| [2] |

Kodituwakku S, Nguyen V K, Turley M D, et al. Strong clutter suppression in non-uniform PRF radar: Techniques based on interpolation & adaptive processing[J]. Iet Radar Sonar and Navigation, 2019, 13(9): 1540-1547. DOI:10.1049/iet-rsn.2018.5632 |

| [3] |

Bacci A, Martorella M, Gray D A, et al. Space-Doppler adaptive processing for radar imaging of moving targets masked by ground clutter[J]. IET Radar, Sonar & Navigation Iet, 2015, 9(6): 712-726. |

| [4] |

Jishy K, Lehmann F. A Bayesian track-before-detect procedure for passive radars[J]. Eurasip Journal on Advances in Signal Processing, 2013, 2013(1): 45-52. DOI:10.1186/1687-6180-2013-45 |

| [5] |

Bjorklund S, Nelander A. Fast-time STAP for clutter suppression between transmitter and receiver in bistatic radar[C]. International Radar Conference. Bordeaux: IEEE, 2009: 1-6.

|

| [6] |

Tao F Y, Wang T, Wu J X, et al. A novel KA-STAP method based on Mahalanobis distance metric learning[J]. Digital Signal Processing, 2020, 97(10): 13-26. |

| [7] |

Guerraou Z, Khenchaf A, Comblet F, et al. Particle filter track-before-detect for target detection and tracking from marine radar data[C]. IEEE Conference on Antenna Measurements & Applications (CAMA). Indonesia: IEEE, 2019: 1-4.

|

| [8] |

Dong Z W, Sun J, Sun J M, et al. Research on sea clutter suppression using sparse dictionary learning[C]. 2019 IEEE 8th Joint International Information Technology and Artificial Intelligence Conference (ITAIC). Chongqing: IEEE, 2019: 967-971.

|

| [9] |

Wang L, Tang J, Liao Q M, et al. A study on radar target detection based on deep neural networks[J]. IEEE Sensors Letters, 2019, 3(3): 1-4. |

| [10] |

Chen X, Su N, Guan J, et al. Integrated processing of radar detection and classification for moving target via time-frequency graph and CNN learning[C]. URSI Asia-Pacific Radio Science Conference (AP-RASC). New Delhi: IEEE, 2019: 1-4.

|

| [11] |

He Q, Lehmann N H, Blum R S, et al. MIMO radar moving target detection in homogeneous clutter[J]. IEEE Transactions on Aerospace and Electronic Systems, 2010, 46(3): 1290-1301. DOI:10.1109/TAES.2010.5545189 |

| [12] |

Reed I S, Gagliardi R M, Stotts L B. Optical moving target detection with 3-D matched filtering[J]. IEEE Transactions on Aerospace and Electronic Systems, 1988, 24(4): 327-336. DOI:10.1109/7.7174 |

| [13] |

Meta A, Hoogeboom P. Signal processing algorithms for FMCW moving target indicator synthetic aperture radar[C]. Proceedings of 2005 IEEE International Geoscience and Remote Sensing Symposium. Seoul Seoul: IEEE, 2005: 316-319.

|

| [14] |

梁璞, 陈兴, 刘让, 等. 基于RFT和AMF融合聚焦的雷达弱小目标检测[J]. 航空兵器, 2019, 26(6): 1-9. (Liang P, Chen X, Liu R, et al. Radar weak target detection based on RFT and AMF fusion focus[J]. Aero Weaponry, 2019, 26(6): 1-9.) |

| [15] |

谷之韬. 基于多普勒雷达传感的多运动目标盲分离研究[D]. 杭州: 浙江大学, 2019. (Gu Z T. Blind separation of multiple motions based on Doppler radar sensing[D]. Hangzhou: Zhejiang University, 2019.) |

| [16] |

Chen V C, Li F, Ho S S, et al. Micro-Doppler effect in radar: Phenomenon, model, and simulation study[J]. IEEE Transactions on Aerospace and Electronic Systems, 2006, 42(1): 2-21. |

| [17] |

Zhou D Y, Shen X F, Yang W L. Radar target recognition based on fuzzy optimal transformation using high-resolution range profile[J]. Pattern Recognition Letters, 2013, 34(3): 256-264. DOI:10.1016/j.patrec.2012.10.010 |

| [18] |

Chen X L, Guan J, Bao Z H, et al. Detection and extraction of target with micromotion in spiky sea clutter via short-time fractional fourier transform[J]. IEEE Transactions on Geoscience and Remote Sensing, 2014, 52(2): 1002-1018. DOI:10.1109/TGRS.2013.2246574 |

| [19] |

Wang Y Z, Liu Q H, Fathy A E, et al. CW and pulse-Doppler radar processing based on FPGA for human sensing applications[J]. IEEE Transactions on Geoscience and Remote Sensing, 2013, 51(5): 3097-3107. |

| [20] |

Molchanov P, Egiazariah K, Astolq J, et al. Classification of small UAVs and birds by micro-Doppler signatures[C]. 2013 European Radar Conference. Nuremberg: IEEE, 2013: 172-175.

|

| [21] |

Tan R, Lim H S, Smits A B, et al. Improvedmicro-Doppler features extraction using Smoothed-Pseudo Wigner-Ville Distribution[C]. 2016 IEEE Region 10 Conference (TENCON). Singapore: IEEE, 2016: 730-733.

|

| [22] |

Sun Y X, Fu H, Abeywickrama S, et al. Drone classification and localization using micro-Doppler signature with low-frequency signal[C]. 2018 IEEE International Conference on Communication Systems (ICCS). Chengdu: IEEE, 2018: 413-417.

|

| [23] |

Kim B K, Kang H S, Park S O, et al. Drone classification using convolutional neural networks withmerged Doppler images[J]. IEEE Geoscience and Remote Sensing Letters, 2017, 14(1): 38-42. DOI:10.1109/LGRS.2016.2624820 |

| [24] |

Ren J F, Jiang X D. Regularized 2-D complex-log spectral analysis and subspace reliability analysis of micro-Doppler signature for UAV detection[J]. Pattern Recognition, 2017, 69: 225-237. DOI:10.1016/j.patcog.2017.04.024 |

| [25] |

Chen K, Li Y, Xu X, et al. Rotating target classification base on micro-Doppler features using a modified adaptive boosting algorithm[C]. International Conference on Computers, Communications, and Systems. Kanyakumari: IEEE, 2015: 236-240.

|

| [26] |

Bj¨ orklund S. Target detection and classification of small drones by boosting on radar micro-Doppler[C]. The 15th European Radar Conference. Madrid: IEEE, 2018: 182-185.

|

| [27] |

Choi B, Oh D. Classification of drone type using deep convolutional neural networks based on microDoppler simulation[C]. 2018 International Symposium on Antennas and Propagation. Busan: IEEE, 2018: 1-2.

|

| [28] |

Liu Y, Liu J Y. Recognition and classification of rotorcraft by micro-Doppler signatures using deep learning[C]. International Conference on Computational Science. Cham: Springer, 2018: 141-152.

|

| [29] |

Torvik B, Olsen K E, Griffiths H D, et al. Classification of birds and UAVs based on radar polarimetry[J]. IEEE Geoscience and Remote Sensing Letters, 2016, 13(9): 1305-1309. DOI:10.1109/LGRS.2016.2582538 |

| [30] |

Kim K T, Seo D K, Kim H T, et al. Efficient radar target recognition using the MUSIC algorithm and invariant features[J]. IEEE Transactions on Antennas and Propagation, 2002, 50(3): 325-337. DOI:10.1109/8.999623 |

| [31] |

牟效乾, 陈小龙, 苏宁远, 等. 基于时频图深度学习的雷达动目标检测与分类[J]. 太赫兹科学与电子信息学报, 2019, 17(1): 105-111. (Mou X Q, Chen X L, Su N Y, et al. Radar detection and classification of moving target using deep convolutional neural networks on time-frequency graphs[J]. Journal of Terahertz Science and Electronic Information Technology, 2019, 17(1): 105-111.) |

| [32] |

Mendis G J, Randeny T, Wei J, et al. Deep learning based doppler radar for micro UAS detection and classification[C]. Cognitive Communications for Aerospace Applications Workshop. Cleveland: IEEE, 2017: 1-5.

|

| [33] |

Ghadaki H, Dizaji R. Target track classification for airport surveillance radar (ASR)[C]. 2006 IEEE Conference on Radar. Verona: IEEE, 2016: 24-27.

|

| [34] |

Samaras S, Magoulianitis V, Dimou A, et al. UAV classification with deep learning using surveillance radar data[C]. International Conference on Computer Vision Systems. Thessaloniki: Springer, 2019: 744-753.

|

| [35] |

Wang Z, Mo C Q, Dai H Y. Target detection method before tracking based on particle filter[J]. Procedia Computer Science, 2017, 107: 141-147. DOI:10.1016/j.procs.2017.03.070 |

| [36] |

Jing C, Lin Z J, Li J L. Detection and tracking of an underwater target using the combination of a particle filter and track-before-detect[C]. OCEANS 2016-Shanghai. Shanghai: IEEE, 2016: 1-5.

|

| [37] |

Chen C L, Li H, Wei Y, et al. A local contrast method for small infrared target detection[J]. IEEE Transactions on Geoscience and Remote Sensing, 2014, 52(1): 574-581. DOI:10.1109/TGRS.2013.2242477 |

| [38] |

Wang W H, Wang P Z, Niu Z D, et al. A real-time detection algorithm for unmanned aerial vehicle target in infrared search system[C]. 2018 IEEE International Conference on Signal Processing, Communications and Computing (ICSPCC). Qingdao: IEEE, 2018: 1-5.

|

| [39] |

Shao X P, Fan H, Lu G X, et al. An improved infrared dim and small target detection algorithm based on the contrast mechanism of human visual system[J]. Infrared Physics & Technology, 2012, 55(5): 403-408. |

| [40] |

谢江荣. 基于深度学习的空中红外目标检测关键技术研究[D]. 北京: 中国科学院大学, 2019. (Xie J R. Research on key technologies of aerial infrared target detection based on deep learning[D]. Beijing: University of Chinese Academy of Sciences, 2019.) |

| [41] |

Wang H, Cai Y F, Chen X B, et al. Night-time vehicle sensing in far infrared image with deep learning[J]. Journal of Sensors, 2016, 2016: 1-8. |

| [42] |

Gundogdu E, Koc A, Alatan A A, et al. Infrared object classification using decision tree based deep neural networks[C]. The 24th Signal Processing and Communication Application Conference. Zonguldak: IEEE, 2016: 1913-1916.

|

| [43] |

Liu Q, Lu X H, He Z Y, et al. Deep convolutional neural networks for thermal infrared object tracking[J]. Knowledge-Based Systems, 2017, 134(7): 189-198. |

| [44] |

Gao P, Ma Y P, Song K, et al. Large margin structured convolution operator for thermal infrared object tracking[C]. The 24th International Conference on Pattern Recognition. Beijing: IEEE, 2018: 2380-2385.

|

| [45] |

Li H, Wu X, Kittler J, et al. Infrared and visible image fusion using a deep learning framework[C]. The 24th International Conference on Pattern Recognition. Beijing: IEEE, 2018: 2705-2710.

|

| [46] |

Ma J Y, Yu W, Liang P W, et al. FusionGAN: A generative adversarial network for infrared and visible image fusion[J]. Information Fusion, 2019, 48: 11-26. DOI:10.1016/j.inffus.2018.09.004 |

| [47] |

张雅雯, 胡士强. 低空目标的雷达/ 可见光协同监视跟踪方法研究[J]. 计算机工程与应用, 2018, 54(6): 234-240. (Zhang Y W, Hu S Q. Research on radar/visible light surveillance and tracking methods of target in low-altitude airspace[J]. Computer Engineering and Applications, 2018, 54(6): 234-240.) |

| [48] |

Chen Y R, Aggarwal P, Choi J, et al. A deep learning approach to dronemonitoring[C]. The Asia-Pacific Signal and Information Processing Association Annual Summit and Conference. Kuala Lumpur: IEEE, 2017: 686-691.

|

| [49] |

Schumann A, Sommer L, Klatte J, et al. Deep cross-domain flying object classification for robust UAV detection[C]. The 14th IEEE International Conference on Advanced Video and Signal Based Surveillance. Lecce: IEEE, 2017.

|

| [50] |

Aker C, Kalkan S. Using deep networks for drone detection[C]. IEEE International Conference on Advanced Video and Signal Based Surveillance. Lecce: IEEE, 2017.

|

| [51] |

Nalamati M, Kapoor A, Saqib M, et al. Drone detection in long-range surveillance videos[C]. The 16th IEEE International Conference on Advanced Video and Signal Based Surveillance. Taipei: IEEE, 2019.

|

| [52] |

Magoulianitis V, Ataloglou D, Dimou A, et al. Does deep super-resolution enhance UAV detection?[C]. The 16th IEEE International Conference on Advanced Video and Signal Based Surveillance. Taipei: IEEE, 2019.

|

| [53] |

Craye C, Ardjoune S. Spatio-Temporal semantic segmentation for drone detection[C]. The 16th IEEE International Conference on Advanced Video and Signal Based Surveillance. Taipei: IEEE, 2019.

|

| [54] |

Sedunov A, Salloum H, Sutin A, et al. UAV passive acoustic detection[C]. 2018 IEEE International Symposium on Technologies for Homeland Security (HST). Woburn: IEEE, 2018: 1-6.

|

| [55] |

Anwar M Z, Kaleem Z, Jamalipour A, et al. Machine learning inspired sound-based amateur drone detection for public safety applications[J]. IEEE Transactions on Vehicular Technology, 2019, 68(3): 2526-2534. DOI:10.1109/TVT.2019.2893615 |

| [56] |

王威, 安腾飞, 欧建平. 无人机被动音频探测和识别技术研究[J]. 声学技术, 2018, 37(1): 89-93. (Wang W, An T F, Ou J P. Research on audio detection and recognition of UAV[J]. Technical Acoustics, 2018, 37(1): 89-93.) |

| [57] |

Jeon S, Shin J W, Lee Y J, et al. Empirical study of drone sound detection in real-life-environment with deep neural networks[C]. The 25th European Signal Processing Conference. Kos: IEEE, 2017: 1858-1862.

|

| [58] |

Liu H, Wei Z Q, Chen Y T, et al. Drone detection based on an audio-assisted camera array[C]. 2017 IEEE Third International Conference on Multimedia Big Data. Laguna Hills: IEEE, 2017: 402-406.

|

| [59] |

Guvenc I, Chong C C. A Survey on TOA based wireless localization and NLOS mitigation techniques[J]. IEEE Communications Surveys & Tutorials, 2009, 11(3): 107-124. |

| [60] |

束强. 基于软件无线电的无线电测向算法研究[D]. 成都: 电子科技大学, 2019. (Shu Q. A research on radio direction finding algorithms based on software defined radio[D]. Chengdu: University of Electronic Science and Technology of China, 2019.) |

| [61] |

Kong M, Liu J, Zhang Z, et al. Radio ground-to-air interference signals recognition based on support vector machine[C]. IEEE International Conference on Digital Signal Processing. Singapore: IEEE, 2015: 987-990.

|

| [62] |

Yan H H, Zhou B, Liu J, et al. Radio signal recognition based on constructing typical spectrum[C]. The 2nd IEEE International Conference on Computer and Communications. Chengdu: IEEE, 2016: 1889-1894.

|

| [63] |

Zhang M, Diao M, Guo L M, et al. Convolutional neural networks for automatic cognitive radio waveform recognition[J]. IEEE Access, 2017, 5: 11074-11082. DOI:10.1109/ACCESS.2017.2716191 |

| [64] |

Li R, Hu J, Yang S, et al. Deep gated recurrent unit convolution network for radio signal recognition[C]. IEEE 19th International Conference on Communication Technology. Xi'an: IEEE, 2019: 159-163.

|

| [65] |

Rajeswari K, Ishwarya A, Vaishnavi K K, et al. Performance analysis of data fusion methods for radar and IRST 3D target tracking[C]. 2017 International Conference on Wireless Communications, Signal Processing and Networking. Chennai: IEEE, 2017: 2570-2574.

|

| [66] |

Ilyas K, Ullah I. A state estimation and fusion algorithm for high-speed low-altitude targets[C]. The 19th International Multi-Topic Conference. Islamabad: IEEE, 2016: 1-5.

|

| [67] |

Luo J Z, Rong C Z, Jia Y X, et al. Fusion of infrared and visible images based on image enhancement and feature extraction[C]. The 11th International Conference on Intelligent Human-Machine Systems and Cybernetics. Hangzhou: IEEE, 2019: 212-216.

|

| [68] |

Wang A L, Jiang J W, Zhang H, et al. Multi-sensor image decision level fusion detection algorithm based on D-S evidence theory[C]. International Conference on Instrumentation and Measurement, Computer, Communication and Control. Harbin: IEEE, 2014: 620-623.

|

| [69] |

Mirzaei G, Jamali M M, Ross J D, et al. Data fusion of acoustics, infrared, and marine radar for avian study[J]. IEEE Sensors Journal, 2015, 15(11): 6625-6632. DOI:10.1109/JSEN.2015.2464232 |

| [70] |

刘清, 张凤坡. 反无人机作战系统加速发展问题探要[N]. 中国航空报, 2018-08-28(7). (Liu Q, Zhang F P. Exploration of the accelerated development of anti-UAV combat system[N]. China Aviation News, 2018-08-28 (7).) |

| [71] |

Ding G R, Wu Q H, Zhang L Y, et al. An amateur drone surveillance system based on the cognitive internet of things[J]. IEEE Communications Magazine, 2018, 56(1): 29-35. DOI:10.1109/MCOM.2017.1700452 |

| [72] |

张静, 张科, 王靖宇, 等. 低空反无人机技术现状与发展趋势[J]. 航空工程进展, 2018, 9(1): 1-8. (Zhang J, Zhang K, Wang J Y, et al. A survey on anti-UAV technology and its future trend[J]. Advances in Aeronautical Science and Engineering, 2018, 9(1): 1-8.) |

| [73] |

王奇珍, 张允清, 唐世玉, 等. 集群无人机探测及对抗措施综述[J]. 现代防御技术, 2019, 47(5): 8-13. (Wang Q Z, Zhang Y Q, Tang S Y, et al. Survey on UAV swarm's detection and confrontation[J]. Modern Defence Technology, 2019, 47(5): 8-13.) |

2022, Vol. 37

2022, Vol. 37