2. 东北大学 智能工业数据解析与优化教育部重点实验室,沈阳 110819;

3. 辽宁省智能工业数据解析与优化工程实验室,沈阳 110819

2. Key Laboratory of Data Analytics and Optimization for Smart Industry, Northeastern University, Shenyang 110819, China;

3. Liaoning Engineering Laboratory of Data Analytics and Optimization for Smart Industry, Shenyang 110819, China

图像分割可以为各种任务提供有价值的信息, 例如缺陷检测、性能预测. 然而, 由于图像之间感兴趣区域的外观、形状和位置的固有可变性以及成像设备和采集协议的差异, 实现准确的分割具有挑战性, 针对特定问题手动设计合理的模型是一项极具依赖专业知识且在试错的过程中极其耗时的任务[1-2].

迫切需求自动设计网络模型的方法促使了神经架构搜索(NAS)技术的发展, 其目标是自动生成强大且性能良好的CNN架构, 将其制定为优化问题, 然后通过精心设计的优化算法加以解决[3-4]. 结合研究问题的特点, 基于种群的ENAS优化算法适用于解决以上提到的问题, 该算法中每个个体都对网络的架构组件进行编码, 并且只有最适合的成员才能生存和增殖. 特别地, 基于进化计算的NAS算法(ENAS)[5-6]通常是全自动的, 它们可以在没有任何人为介入的情况下实现神经架构搜索.

在过去的几年里, ENAS算法由于其高鲁棒性、卓越的性能和完全自动设计神经网络架构的能力引起了人们极大的关注[5, 7]. 在ENAS中, 提升准确率和降低资源消耗一直是要突破的难题. 对于多个互相冲突的优化问题, 多目标进化算法[8-9]已被成功应用. 在已有的多目标进化网络架构算法中, 适用于分割应用的研究还是稀缺的, 而存在的大量分类应用研究并不适合直接应用到分割问题上[10]. 在已有的多目标进化获取分割预测模型的研究中, Baldeon-Calisto等[11]在超参数构建的搜索空间上, 解决最大化预期的分割准确率和最小化网络中的参数数量两个目标优化问题, 提出了以具有固定均衡参数

在上述观察的激励下, 本文提出一种用于图像分割的自适应多目标进化卷积神经结构搜索(AdaMo-ECNAS)方法. 不同的是, 所提出方法用一个三目标函数表述CNN架构的构建问题, 即最大化分割性能指标

多目标进化算法对于进化卷积神经架构的搜索是非常重要的, 这是因为多目标限制其种群更新可以更好地反映个体的多种性能, 在保证其进化个体性能的同时减轻计算负担.

1.2 问题模型 1.2.1 基于进化计算的NAS基于进化计算的NAS (ENAS)[3, 6]算法是一种利用进化计算自动设计神经架构的技术. 特别地, 进化计算是一类基于种群的计算范式, 模拟自然界中物种的进化或种群的行为来解决具有挑战性的优化问题, 具有对局部最小值不敏感和不需要梯度信息的良好特性. 在进化过程中, 不断地对获得的网络模型进行评估, 围绕所研究实际问题的目的将优化问题归纳为单目标[5, 14]或多目标[15-16]的形式.

1.2.2 多目标优化问题具有m个目标函数的多目标优化问题(MOP)描述为

| $ \begin{align} &\min\limits_{x}\; F(x)={({f_1}(x), {f_2}(x), \ldots, {f_m}(x))^{\rm T}};\\ &{\rm{\; s.t.}}\; x\in\varOmega. \end{align} $ | (1) |

其中:

PBI方法定义如下:

| $ \begin{align} &\min\; {g^{\rm pbi}}(x|\lambda , {z^ * }) = {d_1} + \theta {d_2};\\ &{\rm{\; s.t.}}\; {d_1} = \frac{{\| {{{({z^ * } - F(x))}^{\rm T}}\lambda } \|}}{{\| \lambda \|}}, \\ &\; \; \; \; \; \; \; {d_2} = \Big\| {F(x) - \Big({z^ * } + \frac{{{d_1}\lambda }}{{\| \lambda\|}}\Big)} \Big\|. \end{align} $ | (2) |

其中: x为决策向量,

研究分割问题的根本是保证分割性能的提高, 通常将

| $ \begin{align} \min\; {f_1}(x) = 1 - \frac{{2 \times {\rm TP}}}{{2 \times {\rm TP} + {\rm FP}+ {\rm FN}}}. \end{align} $ | (3) |

为了衡量计算成本, 采用FLOPs作为评价目标函数, 一个FLOPs较小的模型意味着它消耗的存储和计算资源较少, 有

| $ \begin{align} \min {f_2}(x) = {\rm{FLOPs}}. \end{align} $ | (4) |

要发现一个非充分训练的模型在推理中是有效的, 具体而言, 一个个体在没有充分训练的情况下有一定的指标表现是非常有希望的, 有

| $ \begin{align} \min\; {f_3}(x)=\frac{{E - {e_{\max }}}}{E}. \end{align} $ | (5) |

其中: E为候选架构训练的最大epochs值,

综上所述, 提出一个三目标优化问题, 采用多目标进化方法获得具有鲁棒性的模型, 克服单一目标不能完全保证其结果鲁棒性的缺点. 首先, 在有限的epochs训练下,

就基于PBI的多目标优化方法而言, 已知具有自适应惩罚参数

| $ \begin{align} \theta = \frac{1}{N} \sum\limits_{i = 1}^N { \sum\limits_{j = 1}^N {\Big( {\frac{{{\lambda ^j} \cdot {F^i}}}{{\| {{F^i}}\|}}} \Big)} }, \end{align} $ | (6) |

其中

针对图像分割的自适应多目标进化卷积神经架构搜索问题, 提出自适应多目标进化NAS算法(AdaMo-ECNAS)进行求解.

2.1 算法回顾构建的网络结构对特定图像数据集的适应过程被建模为一个多目标优化问题, 其基本思想是通过权衡多个目标进化种群, 具体算法流程见算法1. 更多细节在下节阐述. 构建一个三目标优化问题, 考虑

算法1 AdaMo-ECNAS算法框架.

输入: 种群大小N, 邻近区域权重个数T, 最大代数G, 目标数M;

输出: 生成种群P.

1.

2)

3) for g in range (1, G):

4)

5)

6)

7)

8) for i range (N):

9)

10)

11)

12)

13)

14)

15) end

16) end

17) return P

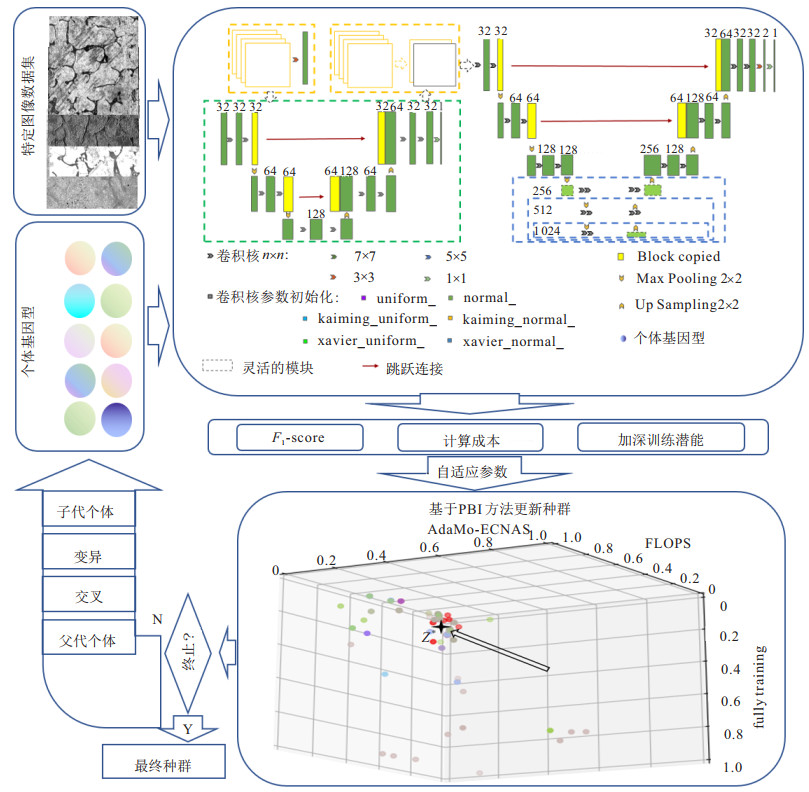

2.2 编码解码策略在卷积神经网络架构搜索过程中, 每个网络架构和超参数都可以被编码为一个个体. 相应地, 进化过程中产生的新个体也可以被解码为相应的网络架构. 架构骨架在图 1中给出, 用于构建个体每个基因的候选值分别为: 激活函数(ReLU, ELU, Softplus, Hardsigmiod, LeakyReLU); 优化函数(RMSprop, Adam, SGD, Adagrad, Adadelta, Adamax, AdamW); 学习率(0.0001, 0.001, 0.01, 0.1, 1.0), 核初始化方式(xavier_uniform, xavier_normal, uniform, kaiming_uniform, kaiming_normal, normal), 卷积网络预处理特征(Yes, No); 层数(3, 4, 5, 6);滤波(Yes, No)和卷积核1-6 (1×1, 3×3, 5×5, 7×7).

|

图 1 提出的AdaMo-ECNAS的整体框架 |

引入多点交叉重新组合来自选定亲本的基因类型, 其中交叉点数量和位置随机选择. 突变算子以一定概率应用于决策向量的随机位置. 在搜索开始时设置一个高的突变概率, 以保证种群多样化. 这允许算法探索搜索空间的不同区域, 避免过早地收敛到低质量区域. 随着代数的增加, 变异概率逐渐降低, 以允许更快的收敛. 每一代g的突变概率为

首先, 随机产生一个初始种群, 并对其初始种群中的个体适配度进行评估; 然后, 整个种群在搜索空间内开始进化过程. 主要步骤如下: 1)计算参考点

所提出的AdaMo-ECNAS算法在PyTorch中实现, 所有实验均在单个NVIDIA Tesla T4上进行, CUDA版本为10.2.

考虑计算成本, 种群大小N和最大代数G分别被经验性地设定为20和10, 批量大小设定为1. 在进化过程中, 训练过程的epochs设定为80. 进化搜索后的最佳架构的微调在900 epochs中进行.

钢铁数据集包含300张图片, 其中250张图片作为训练集, 50张图片作为测试集. 视网膜数据集CHASE_DB1有来自两位专家的不同注释, 但只有第1位专家的注释被用作图像数据标签, 其中前20张图片用于训练, 其余8张图片用作测试集. 本文用0.8和0.2的比例将原始训练集分为训练集和验证集. 比较分割预测模型能力时, 所使用的5个评价指标分别为准确率(Acc)、灵敏度(Sen)、

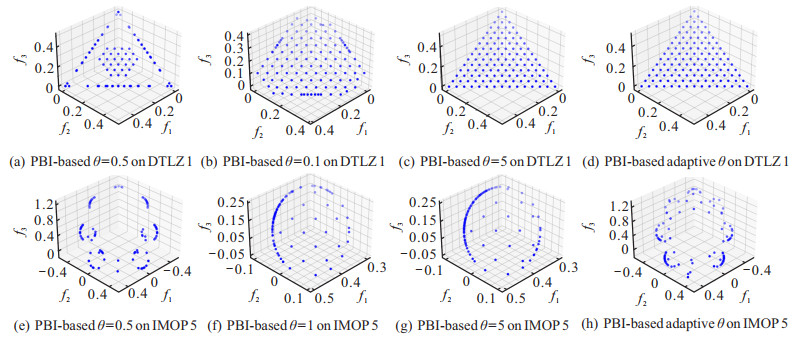

为了更直观地验证所提出基于自适应PBI的多目标优化算法的有效性, 对多目标优化测试函数进行数值实验. 基于自适应PBI的优化方法(AdaMo)在问题DTLZ 1和IMOP 5上进行测试, 测试问题DTLZ 1具有规则的Pareto前沿形状, 而问题IMOP 5具有不连续的Pareto前沿形状.

从图 2中可以看出, 所提出方法得到的解集具有良好的分布性和收敛性. 具体而言, 自适应均衡参数

|

图 2 对应于不同 |

首先研究所提出的AdaMo-ECNAS在钢铁微观结构(先共析渗碳体网状微观结构, PCNM)分割方面的性能, 目的是获得具有较低计算成本和较好分割性能的模型. 渗碳体的存在有助于UHCS的高硬度和耐磨性, 同时伴随的问题是脆性碳化物网络可能成为裂缝, 而裂缝扩展提供了裂缝起始点和途径, 降低了UHCS的韧性/延展性.预测模型的确定分两部分实现, 首先通过三目标进化种群得到最优候选者; 然后对最优个体进行深度训练, 得到具有优良预测能力的模型.

在最终的种群中, 根据PBI的三目标衡量指标筛选出最优个体, 为了进一步验证获得个体的潜力, 对相应的网络和超参数(通过解码方法获得)进行深度训练. 进化搜索后的最佳网络结构微调为900轮迭代训练, 实验结果如表 1所示.

| 表 1 多目标进化获得优良个体的性能与经典架构模型的比较(PCNM) |

从表 1可以看到, 进化获得的优良个体在各个指标上取得了与专业人员手动设计的模型相媲美的结果, 甚至个别指标超越一些手动设计的模型, 且模型的计算浮点(FLOPs)和参数量(params)最小. 特别地, 获得的架构参数量是极小的且其他架构的参数量是其十几倍. 这体现了多目标优化NAS具备降低计算成本的能力, 即所提出方法选出的优良个体具有在降低计算成本情况下保证其性能的特性.

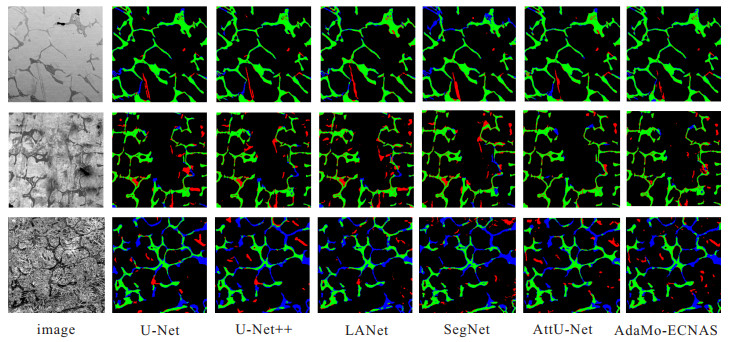

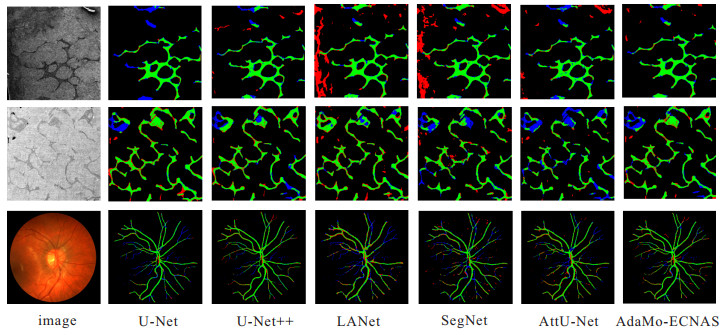

图 3对分割结果的视图可视化直接展现了其分割效果, 直观地比较了不同架构的分割结果. 图像中蓝色像素表示未检测到的先共析渗碳体网状微结构, 红色像素表示错误识别的先共析渗碳体网络微结构. 可以看出, 钢铁微观图像中的微观结构具有一定的复杂性, 图中展示的3张图像特征各异, 使得精准分割图像特征增加了难度, 而所提出算法与其他算法的分割视觉对比发现其细节分割方面达到了较好的性能. 仔细观察图 3中各个方法的分割结果可以发现, 5个指标中

|

图 3 分割结果的视图可视化 |

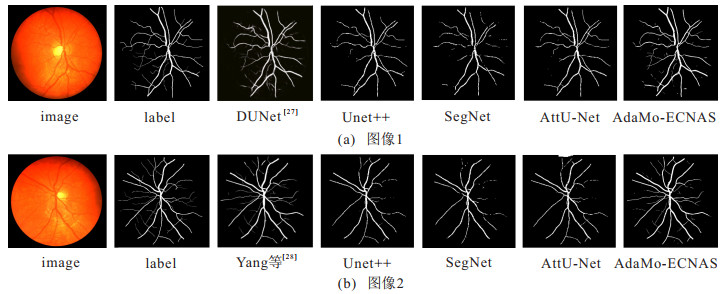

为了进一步验证所提出方法的有效性和普适性, 使用CHASE_DB1数据集进行分割性能评估. 首先验证有效性, 将AdaMo-ECNAS进化获得的最佳架构与已发表文章中报告的架构进行比较. 实验结果分为两部分: 一部分源于已发表文献, 算法在CHASE_DB1数据集上进行验证, 具体数值比较如表 2第1~第7行所示; 另一部分是对表 1中具有代表性的经典模型重新训练获得的评估指标, 具体数值比较如表 2第8~第10行所示. 为了更客观地分析实验结果, 图 4给出了视网膜的可视化分割结果.

| 表 2 在CHASE_DB1数据集上与现有最先进方法比较 |

|

图 4 可视化分割结果 |

观察表 2中准确率(Acc)、灵敏度(Sen)和

综上, 依据表 2和图 4的观察结果, 与其他现有先进方法相比, 所提出方法可以归结为具有3个方面优势: 1)通过多目标进化算法实现了网络架构的自动设计, 同时算法所设计的模型能够达到专家手动设计模型的性能水平; 2)能够在保证分割性能的基础上, 获得规模更小的网络架构模型, 从而显著降低对计算资源的需求; 3)具有一定的普适性, 能够用于不同问题的网络架构自动设计.

3.5 数据集混合实验根据实际问题收集制作的数据集具有不同的数据集特点, 涉及不同且相似的问题设计一个万能模型值得进一步探究和分析. 本节将PCNM和CHASE_DB 1整合成一个混合数据集对其进行训练学习获得预测分割模型, 然后对模型进行测试. 表 3给出了不同测试集的各个性能指标. 由表 3可以发现, 所提出方法的自适应性优于其他方法. 在PCNM + CHASE_DB 1测试数据集上对比不同方法发现, 所提出方法在Acc、Sen和

| 表 3 多目标进化获得优良个体的性能与经典架构模型的比较(PCNM+CHASE_DB 1混合数据集) |

|

图 5 可视化在混合数据集上获得的模型的分割结果 |

下面对比AdaMo-ECNAS方法在单一数据集和混合数据集上获得的实验结果, 即PCNM测试数据集(表 1中AdaMo-ECNAS和表 3中PCNM的AdaMo-ECNAS)和CHASE_DB 1测试数据集(表 2中AdaMo-ECNAS和表 3中CHASE_DB1的AdaMo-ECNAS). 注意到, 混合数据集获得的模型在测试集上获得的性能指标更高一些, 该结果是出乎意料的. 结合数据集规模以及整合两个数据集时统一化处理的特点进一步分析不难发现, PCNM和CHASE_DB1的图像数据量规模比为300 : 28, 为了实现两个数据集共同训练模型, 将CHASE_DB 1数据集处理为与PCNM相同属性的图像数据集. 以上两点表明, 在混合数据集中PCNM数据集是更占优势的, 在混合数据集中占小比例的CHASE_DB 1数据集的存在在某种程度上相当于在训练模型时添加了干扰信息, 这个干扰信息起到了提升模型鲁棒性的效果. 以上分析表明, 数据集混合实验获得的结果是合理的.

4 结论CNN已广泛应用于人工智能, 然而手动设计适合实际问题的架构是一项繁琐的任务, 因此阻碍了其发展.受神经架构搜索和多目标优化的启发, 提出了AdaMo-ECNAS方法用于进化CNNs模型, 采用三目标优化范式, 以最大限度地提高预测分割的

| [1] |

Meng C, Sun K, Guan S Y, et al. Multiscale dense convolutional neural network for DSA cerebrovascular segmentation[J]. Neurocomputing, 2020, 373: 123-134. DOI:10.1016/j.neucom.2019.10.035 |

| [2] |

石雪, 李玉, 赵泉华. 层次混合模型快速遥感影像分割算法[J]. 控制与决策, 2020, 35(6): 1316-1322. (Shi X, Li Y, Zhao Q H. Hierarchical Gaussian mixture model for fast remote sensing image segmentation[J]. Control and Decision, 2020, 35(6): 1316-1322. DOI:10.13195/j.kzyjc.2018.1104) |

| [3] |

Vargas-Hákim G A, Mezura-Montes E, Acosta-Mesa H G. A review on convolutional neural network encodings for neuroevolution[J]. IEEE Transactions on Evolutionary Computation, 2022, 26(1): 12-27. DOI:10.1109/TEVC.2021.3088631 |

| [4] |

Tang L X, Meng Y. Data analytics and optimization for smart industry[J]. Frontiers of Engineering Management, 2021, 8(2): 157-171. DOI:10.1007/s42524-020-0126-0 |

| [5] |

Sun Y N, Xue B, Zhang M J, et al. Automatically designing CNN architectures using the genetic algorithm for image classification[J]. IEEE Transactions on Cybernetics, 2020, 50(9): 3840-3854. DOI:10.1109/TCYB.2020.2983860 |

| [6] |

Xie L X, Yuille A. Genetic CNN[C]. The IEEE International Conference on Computer Vision. Venice, 2017: 1388-1397.

|

| [7] |

Liu Y Q, Sun Y N, Xue B, et al. A survey on evolutionary neural architecture search[J]. IEEE Transactions on Neural Networks and Learning Systems, 2023, 34(2): 550-570. DOI:10.1109/TNNLS.2021.3100554 |

| [8] |

邓武, 蔡幸, 周永权, 等. 一种基于多策略差分进化的分解多目标进化算法[J]. 控制与决策, 2022, 37(2): 387-392. (Deng W, Cai X, Zhou Y Q, et al. A novel decomposition multi-objective evolutionary algorithm based on differential evolution model with multi-strategy[J]. Control and Decision, 2022, 37(2): 387-392. DOI:10.13195/j.kzyjc.2020.1196) |

| [9] |

李二超, 魏立森. 基于指标和自适应边界选择的高维多目标优化算法[J]. 控制与决策, 2022, 37(5): 1183-1194. (Li E C, Wei L S. An indicator-based many-objective evolutionary algorithm with adaptive boundary selection[J]. Control and Decision, 2022, 37(5): 1183-1194. DOI:10.13195/j.kzyjc.2020.1518) |

| [10] |

Lu Z C, Whalen I, Dhebar Y, et al. Multiobjective evolutionary design of deep convolutional neural networks for image classification[J]. IEEE Transactions on Evolutionary Computation, 2021, 25(2): 277-291. DOI:10.1109/TEVC.2020.3024708 |

| [11] |

Baldeon-Calisto M, Lai-Yuen S K. AdaResU-Net: Multiobjective adaptive convolutional neural network for medical image segmentation[J]. Neurocomputing, 2020, 392: 325-340. DOI:10.1016/j.neucom.2019.01.110 |

| [12] |

Baldeon-Calisto M, Lai-Yuen S K. AdaEn-Net: An ensemble of adaptive 2D-3D fully convolutional networks for medical image segmentation[J]. Neural Networks, 2020, 126: 76-94. DOI:10.1016/j.neunet.2020.03.007 |

| [13] |

Bosma M, Dushatskiy A, Grewal M, et al. Mixed-block neural architecture search for medical image segmentation[J/OL]. 2022, arXiv: 2202.11401.

|

| [14] |

Zhang M, Li H Q, Pan S R, et al. Convolutional neural networks-based lung nodule classification: A surrogate-assisted evolutionary algorithm for hyperparameter optimization[J]. IEEE Transactions on Evolutionary Computation, 2021, 25(5): 869-882. DOI:10.1109/TEVC.2021.3060833 |

| [15] |

Wen Y W, Peng S H, Ting C K. Two-stage evolutionary neural architecture search for transfer learning[J]. IEEE Transactions on Evolutionary Computation, 2021, 25(5): 928-940. DOI:10.1109/TEVC.2021.3097937 |

| [16] |

Tong L, Du B. Neural architecture search via reference point based multi-objective evolutionary algorithm[J]. Pattern Recognition, 2022, 132: 108962. DOI:10.1016/j.patcog.2022.108962 |

| [17] |

Wei Z H, Yang J M, Hu Z H, et al. An adaptive decomposition evolutionary algorithm based on environmental information for many-objective optimization[J]. ISA Transactions, 2021, 111: 108-120. DOI:10.1016/j.isatra.2020.10.065 |

| [18] |

Ronneberger O, Fischer P, Brox T. U-net: Convolutional networks for biomedical image segmentation[M]. Lecture Notes in Computer Science. Cham: Springer International Publishing, 2015: 234-241.

|

| [19] |

Zhou Z W, Siddiquee M M R, Tajbakhsh N, et al. UNet++: Redesigning skip connections to exploit multiscale features in image segmentation[J]. IEEE Transactions on Medical Imaging, 2020, 39(6): 1856-1867. DOI:10.1109/TMI.2019.2959609 |

| [20] |

Ding L, Tang H, Bruzzone L. LANet: Local attention embedding to improve the semantic segmentation of remote sensing images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2021, 59(1): 426-435. DOI:10.1109/TGRS.2020.2994150 |

| [21] |

Badrinarayanan V, Kendall A, Cipolla R. SegNet: A deep convolutional encoder-decoder architecture for image segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(12): 2481-2495. DOI:10.1109/TPAMI.2016.2644615 |

| [22] |

Wang S H, Li L, Zhuang X H. AttU-NET: Attention U-net for Brain tumor segmentation[M]. Cham: Springer International Publishing, 2022: 302-311.

|

| [23] |

Li Q L, Feng B W, Xie L P, et al. A cross-modality learning approach for vessel segmentation in retinal images[J]. IEEE Transactions on Medical Imaging, 2016, 35(1): 109-118. DOI:10.1109/TMI.2015.2457891 |

| [24] |

Fan Z, Mo J J. Automated blood vessel segmentation based on de-noising auto-encoder and neural network[C]. International Conference on Machine Learning and Cybernetics. Jeju, 2017: 849-856.

|

| [25] |

Mou L, Chen L, Cheng J, et al. Dense dilated network with probability regularized walk for vessel detection[J]. IEEE Transactions on Medical Imaging, 2020, 39(5): 1392-1403. DOI:10.1109/TMI.2019.2950051 |

| [26] |

Alom M Z, Yakopcic C, Hasan M, et al. Recurrent residual U-net for medical image segmentation[J]. Journal of Medical Imaging, 2019, 6(1): 014006. |

| [27] |

Jin Q G, Meng Z P, Pham T D, et al. DUNet: A deformable network for retinal vessel segmentation[J]. Knowledge-Based Systems, 2019, 178(C): 149-162. |

| [28] |

Yang L, Wang H X, Zeng Q S, et al. A hybrid deep segmentation network for fundus vessels via deep-learning framework[J]. Neurocomputing, 2021, 448: 168-178. DOI:10.1016/j.neucom.2021.03.085 |

| [29] |

Yang D X, Zhao H D, Han T C. Learning feature-rich integrated comprehensive context networks for automated fundus retinal vessel analysis[J]. Neurocomputing, 2022, 491: 132-143. DOI:10.1016/j.neucom.2022.03.061 |